Inferência de IA

NVIDIA Dynamo

Escale e ofereça inferência de IA com rapidez.

Visão Geral

O Sistema Operacional da IA

Atender com eficiência os modelos de linguagem de fronteira atuais geralmente requer recursos que excedem a capacidade de uma única GPU, ou até mesmo de um nó inteiro, tornando a implantação distribuída e em vários nós essencial para a inferência de IA.

O NVIDIA Dynamo é um framework de código aberto e distribuído para execução de inferência, desenvolvido para implantar modelos em ambientes de vários nós em escala de data center. Ele é compatível com mecanismos de inferência de código aberto — incluindo SGLang, NVIDIA TensorRT™ LLM e vLLM — e simplifica as complexidades da execução distribuída ao desagregar fases de inferência em diferentes GPUs, rotear as solicitações para a GPU apropriada de forma inteligente para evitar cálculos redundantes e estender a memória da GPU por meio de cache de dados para camadas de armazenamento com boa relação custo-benefício.

Os microsserviços NVIDIA NIM™ incluirão as capacidades do NVIDIA Dynamo, fornecendo uma opção de implantação rápida e fácil. O NVIDIA Dynamo também será compatível e estará disponível com o NVIDIA AI Enterprise.

Um Olhar Mais Aprofundado no NVIDIA Dynamo

Framework de inferência distribuída de baixa latência para escalar modelos de IA de raciocínio.

Benchmarks independentes mostram que o NVIDIA GB300 NVL72, combinado com o NVIDIA Dynamo, melhora a taxa de processamento de modelos Mixture-of-Expert (MoE) em até 50 vezes em comparação com os sistemas baseados em NVIDIA Hopper™.

O GB300 NVL72 conecta 72 GPUs por meio do NVIDIA NVLink™ de alta velocidade, permitindo a comunicação de especialistas de baixa latência, essencial para modelos de raciocínio MoE. O NVIDIA Dynamo aprimora a eficiência por meio de inferência desagregada, dividindo as fases de pré-preenchimento e decodificação entre nós para otimização independente. Juntos, o GB300 NVL72 e o NVIDIA Dynamo formam um stack de alto desempenho, otimizado para inferência de MoE em larga escala.

Recursos

Explore os Recursos do NVIDIA Dynamo

Acelere a Inferência Distribuída

O NVIDIA Dynamo é totalmente de código aberto, oferecendo a você transparência e flexibilidade completas. Implante o NVIDIA Dynamo, contribua para seu crescimento e integre-o perfeitamente ao seu stack existente.

Confira no GitHub e junte-se à comunidade!

Benefícios

Os Benefícios do NVIDIA Dynamo

Escale Perfeitamente de Uma GPU para Milhares de GPUs

Simplifique e automatize a configuração de clusters de GPUs com ferramentas pré-construídas e fáceis de implantar e permita a escalabilidade automática dinâmica com métricas específicas de LLM em tempo real, evitando o provisionamento excessivo ou insuficiente de recursos de GPU.

Aumente a Capacidade de Serviço de Inferência e Reduza os Custos

Aproveite a inferência de LLM avançada, que serve otimizações, como a execução desagregada e a escala automática com reconhecimento de topologia, para aumentar o número de solicitações de inferência atendidas sem comprometer a experiência do usuário.

Prepare Sua Infraestrutura de IA para o Futuro e Evite Migrações Caras

O design aberto e modular permite que você escolha facilmente os componentes de serviço de inferência que atendem às suas necessidades exclusivas, garantindo compatibilidade com seu stack de IA existente e evitando projetos de migração caros.

Acelere o Tempo para Implantar Novos Modelos de IA em Produção

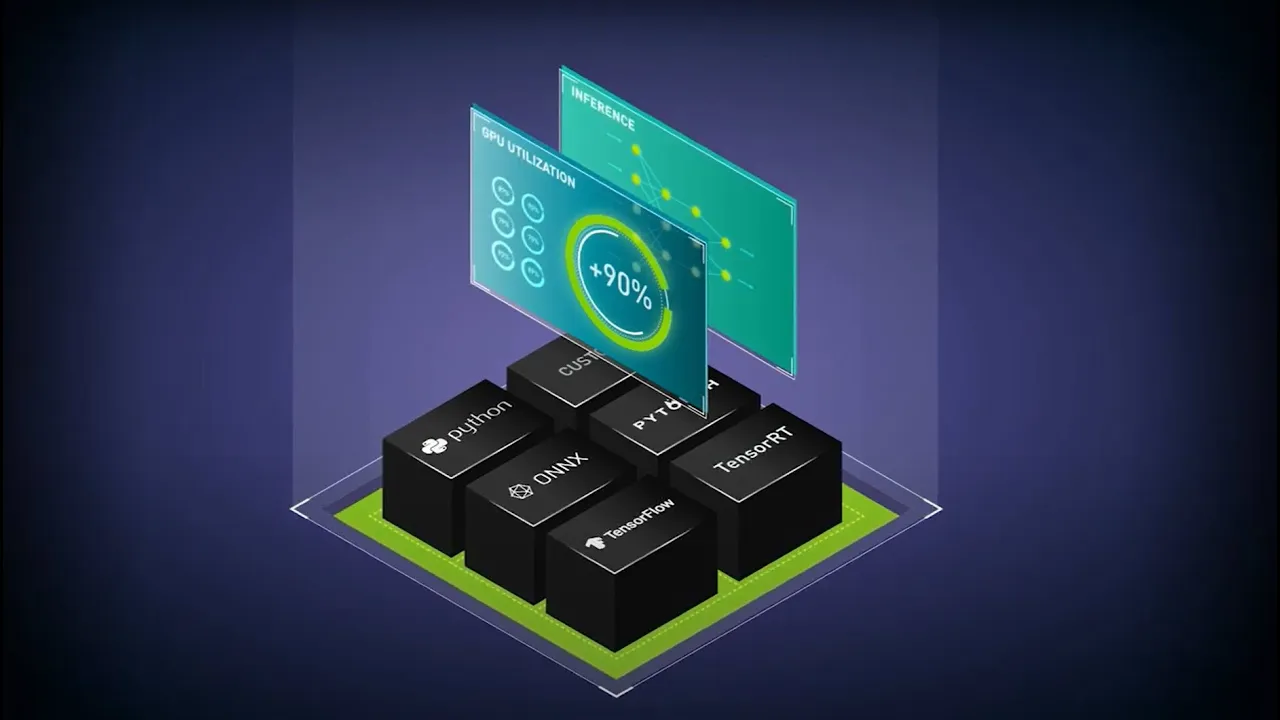

O suporte do NVIDIA Dynamo para todos os principais frameworks, incluindo NVIDIA TensorRT-LLM, vLLM, SGLang, PyTorch e muito mais, garante sua capacidade de implantar rapidamente novos modelos de IA generativa, independentemente de seu backend.

Parceiros do Ecossistema do Dynamo

Casos de Uso

Implantação de IA com o NVIDIA Dynamo

Descubra como você pode impulsionar a inovação com NVIDIA Dynamo.

-

Serviço de Modelos de Lógica

-

Escalabilidade de IA do Kubernetes

-

Implantação de Agentes de IA

-

Geração de Códigos

Serviço de Modelos de Lógica

Os modelos de lógica geram mais tokens para resolver problemas complexos, aumentando os custos de inferência. O NVIDIA Dynamo otimiza esses modelos com recursos como serviço desagregado. Essa abordagem separa as fases computacionais de pré-preenchimento e decodificação em GPUs distintas, permitindo que as equipes de inferência de IA otimizem cada fase de forma independente. O resultado é uma melhor utilização de recursos, mais consultas atendidas por GPU e custos de inferência mais baixos. Quando combinado com o NVIDIA GB200 NVL72, o NVIDIA Dynamo aumenta o desempenho de processamento cumulativo em até 15 vezes.

Escalabilidade de IA do Kubernetes

À medida que os modelos de IA crescem muito para caber em um único nó, servi-los com eficiência torna-se um desafio. A inferência distribuída requer a divisão de modelos em vários nós, o que adiciona complexidade em orquestração, escalabilidade e comunicação em ambientes baseados em Kubernetes. A garantia de que esses nós funcionem como uma unidade coesa, especialmente em workloads dinâmicos, exige gerenciamento cuidadoso. O NVIDIA Dynamo simplifica isso usando o Grove, que cuida perfeitamente do agendamento, da escalabilidade e da execução, para que você possa se concentrar na implantação de IA — não no gerenciamento de infraestrutura.

Agentes de IA Escaláveis

Os agentes de IA geram grandes quantidades de cache KV ao trabalhar com vários modelos (LLMs, sistemas de recuperação e ferramentas especializadas) em tempo real. Esse cache KV geralmente excede a capacidade da memória da GPU, criando um gargalo para escalabilidade e desempenho.

Para superar as limitações de memória da GPU, o armazenamento em cache de dados KV na memória do host ou em armazenamento externo estende a capacidade, permitindo que os agentes de IA escalem sem restrições. O NVIDIA Dynamo simplifica isso com seu KV Cache Manager e integrações com ferramentas de código aberto, como o LMCache, garantindo gerenciamento de cache eficiente e desempenho de agentes de IA escalável.

Geração de Códigos

A geração de código geralmente requer refinamento iterativo para ajustar prompts, esclarecer requisitos ou depurar saídas com base nas respostas do modelo. Essa ida e volta requer recomputação de contexto a cada vez que o usuário volta, aumentando os custos de inferência. O NVIDIA Dynamo otimiza esse processo ao permitir a reutilização de contexto.

O roteador com reconhecimento de LLM do NVIDIA Dynamo gerencia de forma inteligente o cache KV em clusters de GPUs de vários nós. Ele roteia as solicitações com base na sobreposição de cache, direcionando-as para GPUs com o mais alto potencial de reutilização. Isso minimiza a computação redundante e garante desempenho equilibrado em implantações em larga escala.

Depoimentos de Clientes

Veja O Que os Líderes do Setor Têm a Dizer Sobre o NVIDIA Dynamo

Cohere

“A escalabilidade de modelos de IA avançados requer agendamento sofisticado de várias GPUs, coordenação perfeita e bibliotecas de comunicação de baixa latência que transferem contextos de lógica perfeitamente em memória e armazenamento. Esperamos que o Dynamo nos ajude a oferecer uma experiência de usuário de primeira linha a nossos clientes empresariais.”

Saurabh Baji, Vice-Presidente Sênior de Engenharia da Cohere

Perplexity AI

“Como lidamos com centenas de milhões de solicitações por mês, confiamos nas GPUs e no software de inferência da NVIDIA para oferecer o desempenho, a confiabilidade e a escalabilidade que nossa empresa e usuários exigem. Estamos ansiosos para aproveitar o Dynamo, com seus recursos de serviço distribuídos aprimorados, para impulsionar ainda mais eficiências de serviço de inferência e atender às demandas de computação de novos modelos de lógica de IA.”

Denis Yarats, CTO da Perplexity AI.

Together AI

“A escalabilidade de modelos de lógica com economia de custos requer novas técnicas de inferência avançadas, incluindo serviço desagregado e roteamento consciente do contexto. Juntas, a IA fornece desempenho líder do setor usando nosso mecanismo de inferência proprietário. A abertura e a modularidade do NVIDIA Dynamo nos permitirão conectar perfeitamente seus componentes em nosso mecanismo para atender a mais solicitações e otimizar a utilização de recursos, maximizando nosso investimento em computação acelerada.”

Ce Zhang, CTO da Together AI.

Histórias de Clientes

Como os Líderes do Setor Estão Aprimorando a Implantação de Modelos com a Plataforma NVIDIA Dynamo

Recursos

As Últimas Novidades em Inferência da NVIDIA

-

Blogs

-

Sessões

-

Treinamento

-

Vídeos

Próximos Passos

Que Tal Começar Agora?

Faça o download no GitHub e junte-se à comunidade!

Para Desenvolvedores

Explore tudo aquilo de que você precisa para começar a desenvolver com o NVIDIA Dynamo, incluindo a documentação mais recente, tutoriais, blogs técnicos e muito mais.

Fale Conosco

Converse com um especialista em produtos da NVIDIA sobre a mudança da fase de testes para a produção com a segurança, a estabilidade da API e o suporte do NVIDIA AI Enterprise.