Inferenza con AI

NVIDIA Dynamo

Scala e servi l'inferenza IA in poco tempo.

Panoramica

Il sistema operativo dell'IA

Servire in modo efficiente i modelli linguistici di frontiera di oggi spesso richiede risorse che superano la capacità di una singola GPU, o addirittura di un intero nodo, rendendo la distribuzione distribuita e multi-nodo essenziale per l'inferenza IA.

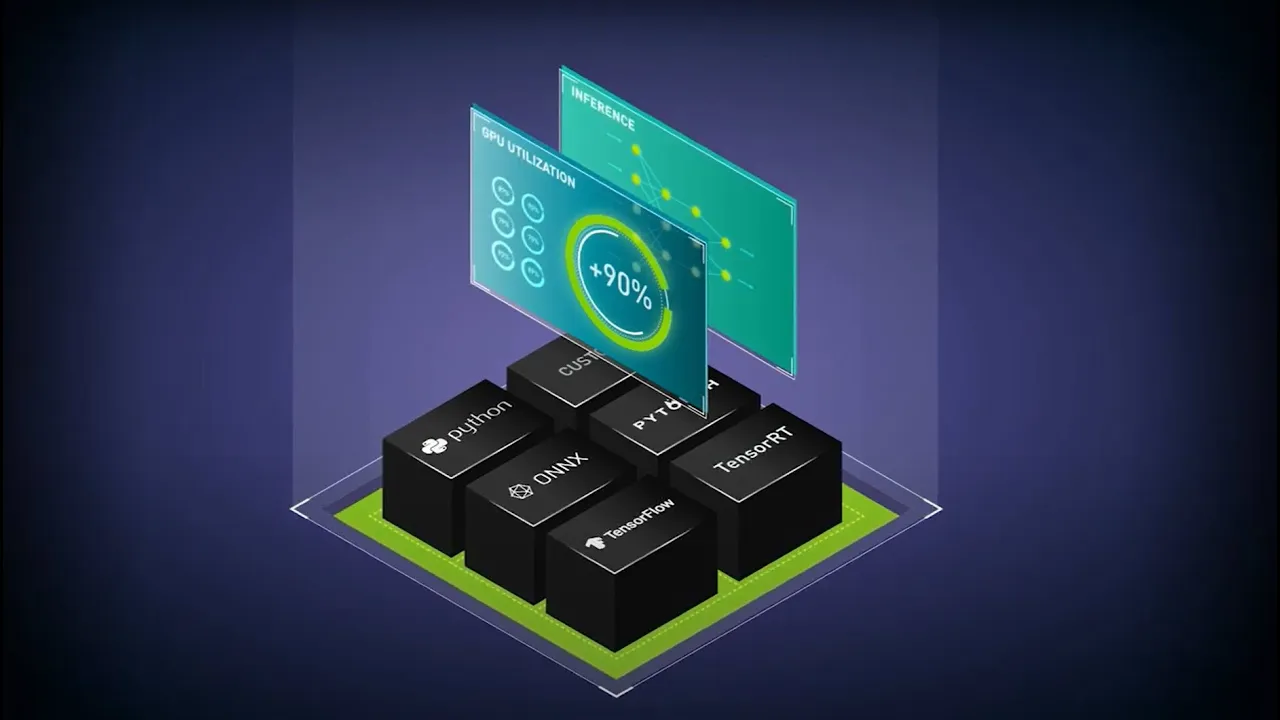

NVIDIA Dynamo è un framework open source distribuito per l'inferenza progettato per distribuire modelli in ambienti multi-nodo a livello di data center. Supporta i motori di inferenza open source, tra cui SGLang, NVIDIA TensorRT™ LLM e vLLM, e semplifica le complessità del servizio distribuito disaggregando le fasi di inferenza su diverse GPU, instradando in modo intelligente le richieste alla GPU appropriata per evitare calcoli ridondanti ed estendendo la memoria delle GPU attraverso il caching dei dati a livelli di storage convenienti.

I microservizi NVIDIA NIM™ includeranno le capacità di NVIDIA Dynamo al fine di fornire un'opzione di distribuzione rapida e facile. Anche NVIDIA Dynamo sarà supportato e disponibile con NVIDIA AI Enterprise.

Uno sguardo più da vicino su NVIDIA Dynamo

Framework di inferenza distribuito a bassa latenza per scalare i modelli IA di ragionamento.

I benchmark indipendenti mostrano come NVIDIA GB300 NVL72 in combinazione con NVIDIA Dynamo migliori il throughput dei modelli Mixture-of-Expert (MoE) fino a 50 volte rispetto ai sistemi basati su NVIDIA Hopper™.

GB300 NVL72 collega 72 GPU tramite NVIDIA NVLink™ ad alta velocità, consentendo una comunicazione di esperti a bassa latenza fondamentale per i modelli di ragionamento MoE. NVIDIA Dynamo migliora l'efficienza attraverso l'inferenza disaggregata, dividendo le fasi di pre-riempimento e decodifica tra i nodi per un'ottimizzazione indipendente. Insieme, GB300 NVL72 e NVIDIA Dynamo formano uno stack ad alte prestazioni ottimizzato per l'inferenza MoE su larga scala.

Funzionalità

Scopri le funzionalità di NVIDIA Dynamo

Accelera l'inferenza distribuita

NVIDIA Dynamo è completamente open source e offre completa trasparenza e flessibilità. Distribuisci NVIDIA Dynamo, contribuisci alla sua crescita e integralo perfettamente nello stack esistente.

Dai un'occhiata su GitHub e iscriviti alla community!

Vantaggi

I vantaggi di NVIDIA Dynamo

Scala facilmente da una GPU a migliaia di GPU

Semplifica e automatizza la configurazione dei cluster GPU con strumenti pre-costruiti e di facile distribuzione e abilita l'autoscaling dinamico con metriche specifiche LLM in tempo reale, evitando l'over-provisioning o l'under-provisioning delle risorse GPU.

Aumenta la capacità del servizio di inferenza riducendo al contempo i costi

Sfrutta le ottimizzazioni avanzate del serving dell'inferenza LLM, come il serving disaggregato e l'autoscaling topology-aware, per aumentare il numero di richieste di inferenza servite senza compromettere l'esperienza utente.

Proteggi la tua infrastruttura IA per il futuro ed evita costose migrazioni

Il design aperto e modulare consente di scegliere facilmente i componenti di inferenza che si adattano alle tue esigenze specifiche, garantendo la compatibilità con lo stack IA esistente ed evitando costosi progetti di migrazione.

Accelera i tempi di distribuzione di nuovi modelli IA in produzione

Il supporto di NVIDIA Dynamo, per tutti i principali framework, tra cui NVIDIA TensorRT-LLM, vLLM, SGLang, PyTorch e molto altro ancora, garantisce la possibilità di distribuire rapidamente nuovi modelli di IA generativa, a prescindere dal loro backend.

Partner dell'ecosistema Dynamo

Casi d'uso

Distribuzione dell'IA con NVIDIA Dynamo

Scopri come puoi promuovere l'innovazione con NVIDIA Dynamo.

-

Servire modelli di ragionamento

-

Scalabilità IA di Kubernetes

-

Distribuire agenti IA

-

Generazione di codice

Servire modelli di ragionamento

I modelli di ragionamento generano più token per risolvere problemi complessi, aumentando i costi di inferenza. NVIDIA Dynamo ottimizza questi modelli con funzionalità come il servizio disaggregato. Questo approccio separa le fasi di pre-riempimento e decodifica in GPU distinte, consentendo ai team di inferenza IA di ottimizzare ogni fase in modo indipendente. Il risultato è un migliore utilizzo delle risorse, un numero maggiore di query servite per GPU e costi di inferenza inferiori. In combinazione con NVIDIA GB200 NVL72, NVIDIA Dynamo aumenta le prestazioni di compounding fino a 15 volte.

Scalabilità IA di Kubernetes

Poiché i modelli IA diventano troppo grandi per adattarsi a un singolo nodo, servirli in modo efficiente diventa una sfida. L'inferenza distribuita richiede la divisione dei modelli su più nodi, aggiungendo complessità nell'orchestrazione, nella scalabilità e nella comunicazione negli ambienti basati su Kubernetes. Assicurarsi che questi nodi funzionino come unità coesa, soprattutto nei carichi di lavoro dinamici, richiede una gestione attenta. NVIDIA Dynamo semplifica questo processo utilizzando Grove, che gestisce facilmente la pianificazione, la scalabilità e il serving, in modo da potersi concentrare sulla distribuzione dell'IA e non sulla gestione dell'infrastruttura.

Agenti IA scalabili

Gli agenti IA generano enormi quantità di cache KV mentre lavorano in tempo reale con più modelli, come LLM, sistemi di recupero e strumenti specializzati. Spesso la cache KV supera la capacità della memoria della GPU, creando un collo di bottiglia per la scalabilità e le prestazioni.

Al fine di superare i limiti di memoria delle GPU, il caching dei dati KV nella memoria host o nello storage esterno estende la capacità, consentendo agli agenti IA di scalare senza vincoli. NVIDIA Dynamo semplifica tutto questo grazie a KV Cache Manager e le integrazioni con strumenti open source come LMCache, garantendo una gestione efficiente della cache e prestazioni scalabili degli agenti IA.

Generazione di codice

La generazione di codice richiede spesso un perfezionamento iterativo per regolare i prompt, chiarire i requisiti o eseguire il debug degli output in base alle risposte del modello. Questo spostarsi avanti e indietro richiede un nuovo calcolo del contesto a ogni turno dell'utente, aumentando i costi di inferenza. NVIDIA Dynamo ottimizza questo processo permettendo di riutilizzare il contesto.

Il router NVIDIA Dynamo, compatibile con LLM, gestisce in modo intelligente la cache KV nei cluster GPU multi-nodo. Indirizza le richieste in base alla sovrapposizione della cache, indirizzandole alle GPU con il più alto potenziale di riutilizzo. Ciò riduce al minimo il calcolo ridondante e garantisce prestazioni bilanciate nelle distribuzioni su larga scala.

Testimonianze dei clienti

Scopri cosa hanno da dire i leader di settore su NVIDIA Dynamo

Cohere

"La scalabilità dei modelli IA avanzati richiede una sofisticata programmazione multi-GPU, un coordinamento semplice e librerie di comunicazione a bassa latenza che trasferiscono facilmente i contesti di ragionamento su memoria e storage. Ci aspettiamo che Dynamo ci aiuti a offrire un'esperienza utente di prim'ordine ai nostri clienti aziendali".

Saurabh Baji, Vice Presidente Senior dell'Ingegneria presso Cohere

Perplexity AI

"Gestiamo centinaia di milioni di richieste ogni mese, ci affidiamo alle GPU e al software di inferenza NVIDIA per offrire le prestazioni, l'affidabilità e la scalabilità che la nostra azienda e i nostri utenti vogliono. Non vediamo l'ora di sfruttare Dynamo e le sue capacità migliorate di serving distribuito per aumentare l'efficienza del serving dell'inferenza e soddisfare le esigenze di calcolo dei nuovi modelli di ragionamento IA."

Denis Yarats, CTO di Perplexity AI.

Together AI

"Una scalabilità conveniente dei modelli di ragionamento richiede nuove tecniche di inferenza avanzate, tra cui il servizio disaggregato e il routing consapevole del contesto. Together AI offre prestazioni leader di settore utilizzando il nostro motore di inferenza proprietario. L'apertura e la modularità di NVIDIA Dynamo ci consentiranno di collegare facilmente i suoi componenti al nostro motore per soddisfare un numero maggiore di richieste e ottimizzare al contempo l'utilizzo delle risorse, massimizzando l'investimento nel calcolo accelerato".

Ce Zhang, CTO di Together AI.

Testimonianze dei clienti

Come i leader del settore stanno migliorando la distribuzione dei modelli con la piattaforma NVIDIA Dynamo

NVIDIA Blackwell Ultra offre prestazioni fino a 50 volte migliori e costi 35 volte inferiori per l'IA per agenti

Progettata per accelerare la nuova generazione di IA per agenti, NVIDIA Blackwell Ultra offre prestazioni di inferenza rivoluzionarie con costi notevolmente inferiori. I fornitori di cloud come Microsoft, CoreWeave e Oracle Cloud Infrastructure stanno distribuendo sistemi NVIDIA GB300 NVL72 su larga scala per casi d'uso a bassa latenza e con contesti estesi, come la codifica agentica e gli assistenti di codifica.

Ciò è reso possibile dalla profonda co-progettazione tra NVIDIA Blackwell, NVLink™ e NVLink Switch per la scalabilità, NVFP4 per la precisione a bassa latenza e NVIDIA Dynamo e TensorRT™ LLM per la velocità e la flessibilità, nonché dallo sviluppo con i framework della community SGLang, vLLM e molto altro ancora.

Risorse

Le ultime novità su NVIDIA Inference

-

Blog

-

Sessioni

-

Formazione

-

Video

Prossimi passi

È tutto pronto per iniziare?

Scarica su GitHub e unisciti alla community!

Sviluppatori

Scopri tutto ciò di cui hai bisogno per iniziare a sviluppare con NVIDIA Dynamo, tra cui la documentazione più recente, i tutorial, i blog tecnici e molto altro.

Contattaci

Parla con uno specialista di prodotto NVIDIA per passare dal progetto pilota alla produzione grazie alla sicurezza, alla stabilità delle API e al supporto di NVIDIA AI Enterprise.