概覽

NVIDIA NeMo 是什麼?

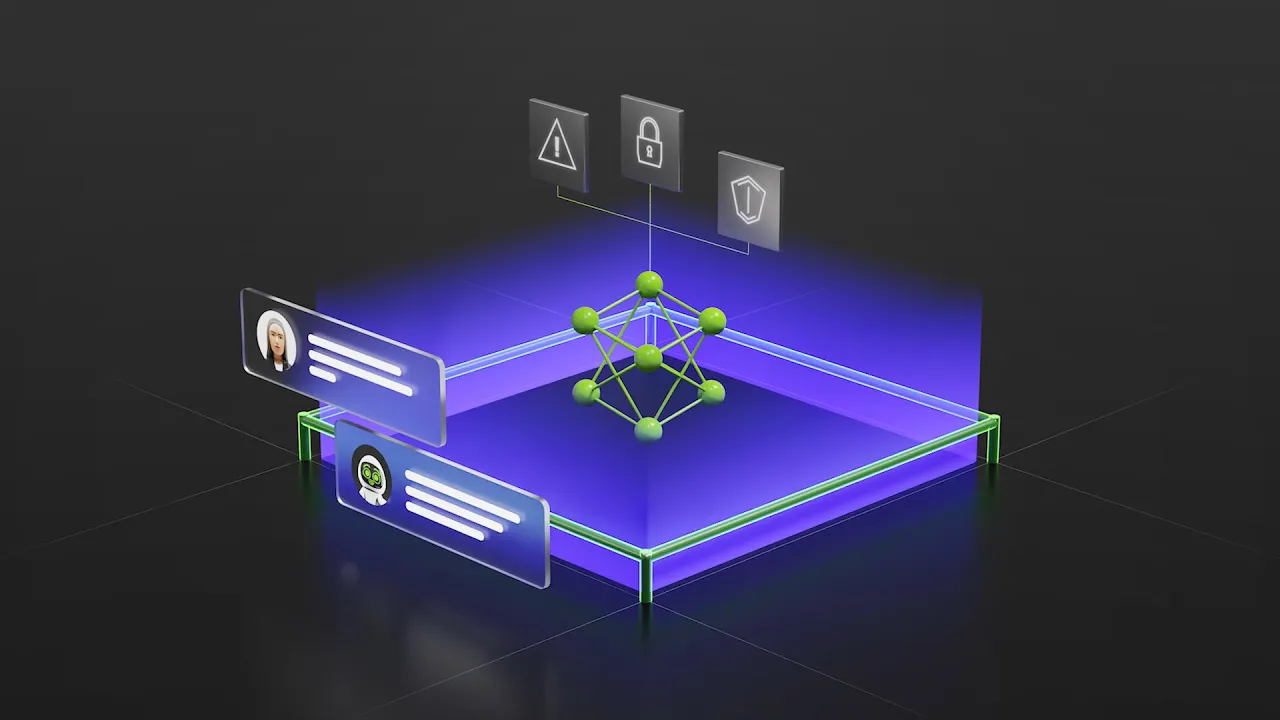

NVIDIA NeMo™ 是一套全方位的工具套件,用於管理 AI 代理程式生命週期。 包括開放式函式庫與微服務,用於資料處理、資料生成、模型微調與評估、強化學習、語音、安全與代理可觀察性。 利用 NeMo 自訂 NVIDIA Nemotron™ 與其他開放模型,建立根據您的領域需求與資料量身打造的生產級專用代理式系統。

與現有的 AI 平台整合,支援雲端、內部部署與混合部署。

特色

管理 AI 代理生命週期的工具

AI 代理生命週期是實際應用時開發及改善 AI 代理的端到端流程。NVIDIA NeMo 提供實現這項工作流程每一步的工具,讓企業能打造強大、安全且持續學習的代理。

| 打造 | |

|---|---|

| 準備 AI 就緒的資料 處理現有的多模態資料集,將其轉化為開發流程用的高品質 AI 就緒格式,並生成合成資料,縮小關鍵的資料差距。 |

|

| 選擇合適的模型 挑選或打造適合使用案例的模型:選擇開放式 Nemotron 模型、其他開放式或專有選項,或者從頭開始訓練。 透過評估執行來驗證,並根據需要微調。 |

|

| 建立您的 AI 代理程式 分析並最佳化跨框架的代理式工作流程,具備內建效能分析、瓶頸偵測、評估驅動的 RL 調整,以及與 LangChain、LlamaIndex 及其他代理生態系的互通性。 |

|

| 部署 | |

| 以最高效能部署代理 利用高傳輸量低延遲的推論,為正式環境將代理最佳化,確保能隨著企業需求擴充,並提供快速可靠的回應。 |

|

| 確保資料關聯性並套用防護措施: 利用檢索增強生成 (RAG) 將代理程式回應固定於可信賴的知識,同時套用安全、合規與內容審核防護措施。 |

|

| 最佳化 | |

| 監測及收集意見回饋 追蹤代理與使用者和其他系統的實際互動。以系統化的方式評估效能與準確度,尋找持續改善的機會。 |

|

| 利用資料飛輪持續改善 運用從監測過程收集的意見回饋與資料打造資料驅動的飛輪,以迭代方式重新訓練代理,經年累月持續最佳化並維持高效。 |

|

使用案例

NeMo 的使用方式

瞭解 NVIDIA NeMo 如何支援產業使用案例,幫助您快速展開 AI 開發。

-

AI 代理

-

代理 AI 的 SDG

-

AI 助理

-

企業搜尋

-

內容生成

-

人形機器人

AI 代理

AI 代理正翻轉各行各業的客戶服務,協助公司提升與客戶對話體驗、實現高問題解決率,並改善人工客服的生產力。AI 代理可處理預測性任務、推理和解決問題,以及接受理解特定產業術語的訓練,並且從組織的知識庫提取相關資訊,不受資料存放位置限制。

代理 AI 的合成資料生成

專屬代理系統需要大量的高品質資料集,但從真實世界來源收集的過程緩慢又昂貴。藉由模擬或生成式 AI 模型產生的合成資料,企業可突破資料瓶頸,安心建立大量訓練場景,無需擔憂隱私或品質風險。這樣一來,便可加速開發推理 LLM、多步驟決策系統,以及多模態 AI 助理。

企業搜尋

企業每年產生數兆份文件,包括 PDF、報告、簡報,每份文件都包含文字、圖片、圖表與表格,而且分佈在互不相連的系統中。採用 AI 技術的企業搜尋可將這種分散的資料轉化為統一的知識庫,讓員工透過自然語言即時挖掘深入解析,並以更低的成本加速決策制定。

內容生成

生成式 AI 可產生高度相關、量身打造且準確的內容,而且完全根植於貴企業的領域專業知識和專有智慧財產。

人形機器人

人形機器人可快速因應現行之以人為本的城市與工業工作空間,處理繁瑣、重複或耗費大量體力的工作。這類機器人的用途多元,無論是工廠或醫療機構皆適用,可在各種場所協助人類、透過自動化減輕勞動力短缺的問題。

Apptronik

優勢

探索 NVIDIA NeMo 在代理 AI 方面的優勢

全面的模組化 AI 代理套件

利用可互通的企業級軟體套件,管理完整的代理程式生命週期,包括資料整理與後期訓練,以及評估、防護措施、可觀察性與持續最佳化。

大規模加速

利用企業資料,透過 GPU 加速的訓練、推論、多節點擴充,以及具成本效益的最佳化,為高傳輸量的代理工作負載部署及擴充資料飛輪。

投資報酬率更高

加速建構、客製化及部署專用的代理式系統,縮短正式環境部署時間並最大化 AI 投資報酬。

客戶案例

產業領導者如何運用 NeMo 推動創新

採用者

各行各業的頂尖採用者

-

客戶

-

合作夥伴

資源

NVIDIA NeMo 資源的最新消息

-

演講

-

部落格文章

-

訓練

-

影片

後續步驟

準備好開始了嗎?

運用正確的工具與技術,將代理 AI 應用從開發階段推進到正式環境。

開發人員專區

探索開始使用 NVIDIA NeMo 開發所需的一切資源,包括最新說明文件、教學課程與技術部落格等。

聯絡我們

洽詢 NVIDIA 產品專家,並瞭解如何運用 NVIDIA AI Enterprise 提供的安全性、API 穩定性與支援,確保產品從試產階段順利推進至正式環境。