KI-Inferenz

NVIDIA Dynamo

Skalieren und Bereitstellen von KI-Inferenz – und zwar schnell.

Überblick

Das Betriebssystem der KI

Die effiziente Bereitstellung heutiger Frontier-Sprachmodelle erfordert häufig Ressourcen, die die Kapazität einer einzelnen GPU – oder sogar eines gesamten Knotens – überschreiten. Dies macht eine verteilte Multi-Knoten-Bereitstellung für KI-Inferenz unerlässlich.

NVIDIA Dynamo ist ein quelloffenes, verteiltes Inferenz-Serving-Framework, das für die Bereitstellung von Modellen in Multi-Knoten-Umgebungen auf Rechenzentrumsniveau entwickelt wurde. Es unterstützt Open-Source-Inferenz-Engines – darunter SGLang, NVIDIA TensorRT™ LLM und vLLM – und vereinfacht die Komplexität der verteilten Bereitstellung durch Disaggregation von Inferenzphasen über verschiedene GPUs, intelligente Weiterleitung von Anfragen an die entsprechende GPU, um redundante Berechnungen zu vermeiden, und Erweiterung des GPU-Speichers durch Daten-Caching auf kostengünstige Datenspeicherstufen.

NVIDIA NIM™Microservices werden NVIDIA Dynamo-Funktionen enthalten und eine schnelle und einfache Bereitstellungsoption bieten. NVIDIA Dynamo wird auch mit NVIDIA AI Enterprise unterstützt und verfügbar sein.

Ein genauerer Blick auf NVIDIA Dynamo

Verteiltes Inferenzframework mit geringer Latenz für die Skalierung von Reasoning-KI-Modellen.

Unabhängige Benchmarks zeigen, dass NVIDIA GB300 NVL72 in Kombination mit NVIDIA Dynamo den Durchsatz von MoE-Modellen (Mixture-of-Expert) um das bis zu 50-Fache im Vergleich zu auf NVIDIA Hopper™ basierenden Systemen verbessert.

Das GB300 NVL72 verbindet 72 GPUs über das Highspeed-NVIDIA-NVLink™ und ermöglicht eine Expertenkommunikation mit geringer Latenz, die für MoE-Reasoning-Modelle entscheidend ist. NVIDIA Dynamo verbessert die Effizienz durch disaggregierte Inferenz und teilt Prefill- und Dekodierungsphasen über Knoten für eine unabhängige Optimierung auf. Zusammen bilden GB300 NVL72 und NVIDIA Dynamo einen leistungsstarken Stack, der für umfangreiche MoE-Inferenz optimiert ist.

Merkmale

Funktionen von NVIDIA Dynamo

Beschleunigte verteilte Inferenz

NVIDIA Dynamo ist vollständig Open Source, was Ihnen volle Transparenz und Flexibilität bietet. Setzen Sie NVIDIA Dynamo ein, tragen Sie zu seiner Weiterentwicklung bei und integrieren Sie Dynamo nahtlos in Ihre vorhandene Lösung.

Sehen Sie es sich auf GitHub an und werden Sie Teil der Community!

Vorteile

Vorteile von NVIDIA Dynamo

Nahtlose Skalierung von einer einzelnen GPU auf Tausende GPUs

Optimieren und automatisieren Sie die Einrichtung von GPU-Clustern mit vorgefertigten, einfach zu implementierenden Tools, und ermöglichen Sie die dynamische automatische Skalierung mit LLM-spezifischen Echtzeit-Kennwerten, um eine Über- oder Unterdimensionierung von GPU-Ressourcen zu vermeiden.

Erhöhung der Inferenz-Verarbeitungskapazität bei gleichzeitiger Kostenreduzierung

Nutzen Sie fortschrittliche LLM-Inferenz-Serving-Optimierungen wie disaggregiertes Serving und topologiebewusstes Autoskalieren, um die Anzahl der bearbeiteten Inferenzanfragen zu erhöhen, ohne die Benutzererfahrung zu beeinträchtigen.

Machen Sie Ihre KI-Infrastruktur zukunftssicher und vermeiden Sie kostspielige Migrationen

Das offene und modulare Design ermöglicht es Ihnen, ganz einfach die Komponenten für die Inferenz-Verarbeitung auszuwählen, die Ihren individuellen Anforderungen entsprechen, und so die Kompatibilität mit Ihrer bestehenden KI-Struktur sicherzustellen und kostspielige Migrationsprojekte zu vermeiden.

Verkürzen Sie die Zeitspanne bis zur Bereitstellung neuer KI-Modelle im Produktivbetrieb

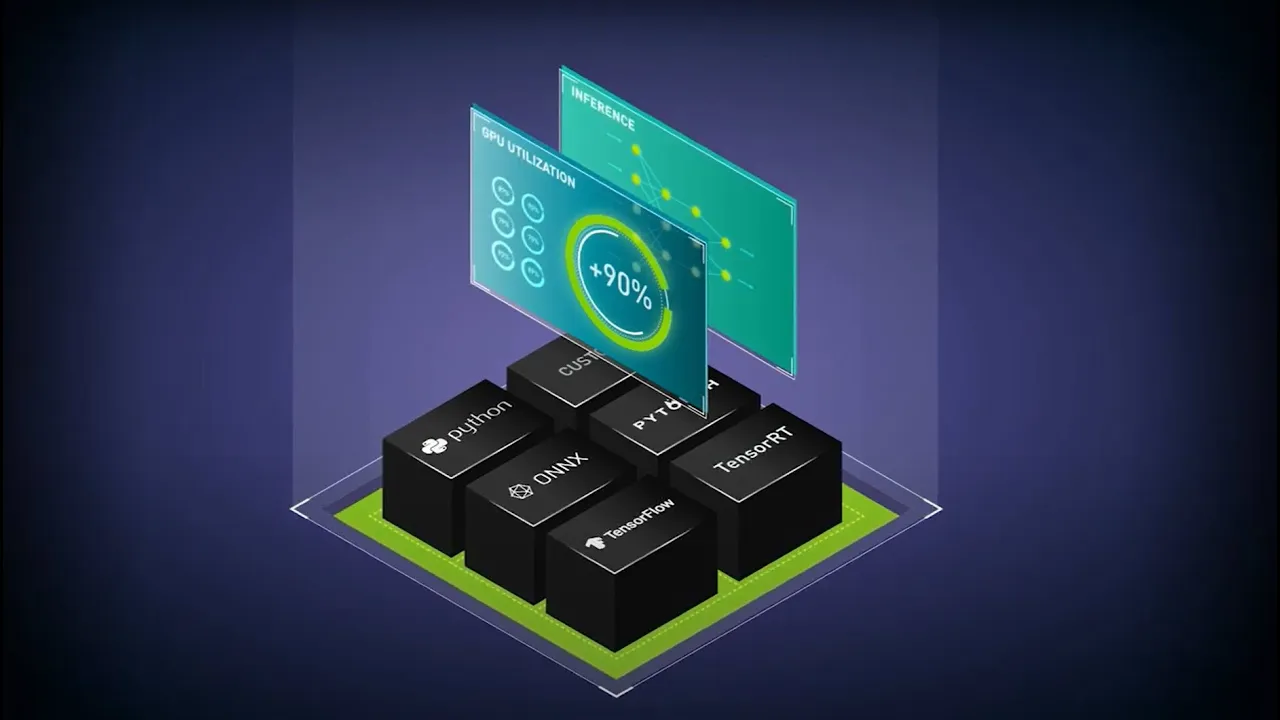

Die Unterstützung von NVIDIA Dynamo für alle wichtigen Frameworks – darunter NVIDIA TensorRT-LLM, vLLM, SGLang, PyTorch und mehr – stellt sicher, dass Sie neue generative KI-Modelle schnell bereitstellen können, unabhängig von ihrem Backend.

Dynamo-Ökosystempartner

Anwendungsbeispiele

Bereitstellung von KI mit NVIDIA Dynamo

Erfahren Sie, wie Sie mit NVIDIA Dynamo die Innovation vorantreiben können.

-

Verarbeitung von Reasoning-Modellen

-

Kubernetes KI-Skalierung

-

Bereitstellung von KI-Agenten

-

Code-Generierung

Verarbeitung von Reasoning-Modellen

Reasoning-Modelle erzeugen mehr Token, um komplexe Probleme zu lösen, was die Inferenzkosten erhöht. NVIDIA Dynamo optimiert diese Modelle mit Funktionen wie entkoppelter Verarbeitung. Dieser Ansatz unterteilt die Prefill- und Decode-Rechenphasen auf verschiedene GPUs, sodass KI-Inferenzteams jede Phase unabhängig optimieren können. Das führt zu einer besseren Auslastung der Ressourcen, mehr verarbeiteten Abfragen pro GPU und zu geringeren Inferenzkosten. In Kombination mit der NVIDIA GB200 NVL72 steigert NVIDIA Dynamo die Compounding-Leistung um das bis zu 15-Fache.

Kubernetes KI-Skalierung

Wenn KI-Modelle zu groß für einen einzelnen Knoten werden, wird ihre effiziente Verarbeitung zum Problem. Verteilte Inferenz erfordert die Aufteilung von Modellen über mehrere Knoten hinweg, was die Komplexität von Orchestrierung, Skalierung und Kommunikation in Kubernetes-basierten Umgebungen erhöht. Damit diese Knoten – insbesondere bei dynamischen Workloads – als zusammenhängende Einheit funktionieren, bedarf es einer sorgfältigen Verwaltung. NVIDIA Dynamo vereinfacht dies durch den Einsatz von Grove, das Planung, Skalierung und Bereitstellung nahtlos verarbeitet, sodass Sie sich auf die Bereitstellung von KI konzentrieren können und nicht auf die Verwaltung der Infrastruktur.

Skalierbare KI-Agenten

KI-Agenten generieren riesige Mengen an KV-Cache, da sie mit mehreren Modellen – LLMs, Retrieval-Systemen und spezialisierten Tools – in Echtzeit arbeiten. Dieser KV-Cache übersteigt häufig die Kapazität des GPU-Speichers und schafft einen Engpass für Skalierung und Leistung.

Um GPU-Speichereinschränkungen zu umgehen, erweitert das Caching von KV-Daten im Host-Speicher oder externen Datenspeicher die Kapazität, sodass KI-Agenten ohne Einschränkungen skalieren können. NVIDIA Dynamo vereinfacht dies mit dem KV Cache Manager und Integrationen mit Open-Source-Tools wie LMCache und gewährleistet ein effizientes Cache-Management und skalierbare Leistung von KI-Agenten.

Code-Generierung

Die Generierung von Programmcode erfordert oft eine iterative Verfeinerung, um Prompts anzupassen, Anforderungen zu klären oder die Ausgabe basierend auf den Antworten des Modells zu debuggen. Dieses Hin und Her macht es notwendig, den Kontext bei jeder Eingabe des Benutzers neu zu berechnen, was die Inferenzkosten erhöht. NVIDIA Dynamo optimiert diesen Prozess, indem es die Wiederverwendung von Kontext ermöglicht.

Der LLM-fähige Router von NVIDIA Dynamo verwaltet den KV-Cache über Multi-Knoten-GPU-Cluster hinweg intelligent. Er leitet Anfragen basierend auf Cache-Überschneidungen weiter und führt sie GPUs mit dem höchsten Wiederverwendungspotenzial zu. Dies minimiert redundante Berechnung und gewährleistet eine ausgewogene Leistung in umfangreichen Bereitstellungen.

Kundenreferenzen

Was Branchenführer über NVIDIA Dynamo sagen

Cohere

„Die Skalierung hochentwickelter KI-Modelle erfordert eine ausgefeilte Multi-GPU-Zuteilung, nahtlose Koordination und Low-Latency-Communication-Bibliotheken, die Reasoning-Kontexte nahtlos in Arbeits- und Datenspeicher übertragen. Wir gehen davon aus, dass Dynamo uns helfen wird, unseren Unternehmenskunden ein erstklassiges Benutzererlebnis zu bieten.“

Saurabh Baji, Senior Vice President of Engineering bei Cohere

Perplexity-KI

„Wir bearbeiten Hunderte Millionen von Anfragen monatlich und verlassen uns auf die GPUs und Inferenzsoftware von NVIDIA, um die Leistung, Zuverlässigkeit und Skalierbarkeit zu liefern, die unser Unternehmen und unsere Benutzer fordern. Wir freuen uns darauf, Dynamo mit seinen verbesserten verteilten Serving-Funktionen zu nutzen, um die Effizienz des Inferenz-Serving noch zu steigern und die Rechenanforderungen neuer KI-Reasoning-Modelle zu erfüllen.“

Denis Yarats, CTO von Perplexity AI.

Together AI

„Eine kostengünstige Skalierung von Reasoning-Modellen erfordert neue fortgeschrittene Inferenz-Techniken, einschließlich entkoppelter Verarbeitung und kontextsensitiver Weiterleitung. Together AI bietet mithilfe seiner proprietären Inferenz-Engine branchenführende Leistung. Die Offenheit und Modularität von NVIDIA Dynamo wird uns ermöglichen, seine Komponenten nahtlos an unsere Engine anzuschließen, um mehr Abfragen zu verarbeiten und gleichzeitig die Auslastung der Ressourcen zu optimieren – und damit maximalen Nutzen aus unseren Investitionen in beschleunigtes Computing zu ziehen.“

Ce Zhang, CTO von Together AI.

Erfolgsgeschichten

Wie Branchenführer die Bereitstellung von Modellen mit der NVIDIA Dynamo-Plattform verbessern

NVIDIA Blackwell Ultra liefert bis zu 50-mal bessere Leistung und 35-mal geringere Kosten für agentische KI

NVIDIA Blackwell Ultra wurde entwickelt, um die nächste Generation der agentischen KI zu beschleunigen und bietet bahnbrechende Inferenzleistung bei deutlich geringeren Kosten. Cloud-Anbieter wie Microsoft, CoreWeave und Oracle Cloud Infrastructure setzen NVIDIA GB300 NVL72-Systeme in großem Maßstab für Anwendungsfälle mit geringer Latenz und langer Kontextdauer ein, wie zum Beispiel agentische Programmierung und Programmierassistenten.

Dies wird durch ein eng abgestimmtes Co-Design zwischen NVIDIA Blackwell, NVLink™ und NVLink Switch für Scale-out, NVFP4 für Genauigkeit bei Berechnungen mit niedriger Präzision und NVIDIA Dynamo sowie TensorRT™ LLM für Geschwindigkeit und Flexibilität ermöglicht – sowie durch die Entwicklung mit Community-Frameworks wie SGLang, vLLM und mehr.

Ressourcen

Aktuelles zur NVIDIA-Inferenzplattform

-

Blogs

-

Veranstaltungen

-

Schulungen

-

Videos

Nächste Schritte

Sind Sie bereit?

Laden Sie auf GitHub herunter und treten Sie der Community bei!

Für Entwickler

Informieren Sie sich über alles, was Sie für den Einstieg in die Entwicklung mit NVIDIA Dynamo benötigen, einschließlich der neuesten Dokumentation, Tutorials, technischen Blogs und mehr.

Kontakt aufnehmen

Sprechen Sie mit einem NVIDIA-Produktspezialisten über den Wechsel vom Pilot- zum Produktivbetrieb mit der Sicherheit, API-Stabilität und Unterstützung von NVIDIA AI Enterprise.