Inferencia de IA

NVIDIA Dynamo

Escalar y servir inferencia de IA rápidamente.

Descripción

El sistema operativo de IA

El servicio eficiente de los modelos de lenguaje de vanguardia actuales a menudo requiere recursos que superan la capacidad de una sola GPU, o incluso de un nodo completo, lo que hace que la implementación distribuida de varios nodos sea esencial para la inferencia de IA.

NVIDIA Dynamo es un marco de servicio de inferencia distribuida de código abierto diseñado para implementar modelos en entornos de varios nodos a escala de centro de datos. Es compatible con motores de inferencia de código abierto, incluidos SGLang, NVIDIA TensorRT™ LLM y vLLM, y simplifica las complejidades del servicio distribuido al desagregar las fases de inferencia en diferentes GPU, enrutar de forma inteligente las solicitudes a la GPU adecuada para evitar la computación redundante y ampliar la memoria de la GPU a través de la caché de datos a niveles de almacenamiento rentables.

Los microservicios NVIDIA NIM™ incluirán capacidades de NVIDIA Dynamo y proporcionarán una opción de implementación rápida y fácil. NVIDIA Dynamo también será compatible y estará disponible con NVIDIA AI Enterprise.

Una mirada más cercana a NVIDIA Dynamo

Marco de inferencia distribuida de baja latencia para escalar modelos de IA de razonamiento.

Las pruebas de referencia independientes muestran que NVIDIA GB300 NVL72 combinado con NVIDIA Dynamo mejora el rendimiento de los modelos de mezcla de expertos (MoE) hasta 50 veces en comparación con los sistemas basados en NVIDIA Hopper™.

El GB300 NVL72 conecta 72 GPU a través de NVIDIA NVLink™ de alta velocidad, lo que permite una comunicación experta de baja latencia, lo que resulta esencial para los modelos de razonamiento de MoE. NVIDIA Dynamo mejora la eficiencia a través de la inferencia desagregada, dividiendo las fases de prellenado y descodificación en todos los nodos para una optimización independiente. Juntos, GB300 NVL72 y NVIDIA Dynamo forman una pila de alto rendimiento optimizada para la inferencia de MoE a gran escala.

Características

Explore las características de NVIDIA Dynamo

Acelere la inferencia distribuida

NVIDIA Dynamo es totalmente de código abierto, lo que le ofrece transparencia y flexibilidad completas. Implemente NVIDIA Dynamo, contribuya a su crecimiento e intégrelo a la perfección en su pila existente.

¡Échele un vistazo en GitHub y únase a la comunidad!

Ventajas

Las ventajas de NVIDIA Dynamo

Escale a la perfección desde una GPU a miles de GPU

Agilice y automatice la configuración de clústeres de GPU con herramientas prediseñadas y fáciles de implementar y permita el autoescalado dinámico con métricas específicas de LLM en tiempo real, evitando el sobreaprovisionamiento o el aprovisionamiento insuficiente de recursos de GPU.

Aumente la capacidad de servicio de inferencia al tiempo que reduce los costes

Aproveche lala inferencia de LLM avanzada que sirve optimizaciones, como el servido desagregado y el escalado automático sensible a la topología para aumentar el número de solicitudes de inferencia servidas sin poner en peligro la experiencia del usuario.

Prepare su infraestructura de IA para el futuro y evite costosas migraciones

El diseño abierto y modular le permite seleccionar fácilmente los componentes que sirven inferencia y que se adaptan a sus necesidades únicas, garantizándole la compatibilidad con su pila de IA existente y evitando costosos proyectos de migración.

Acelere el tiempo para implementar nuevos modelos de IA en producción

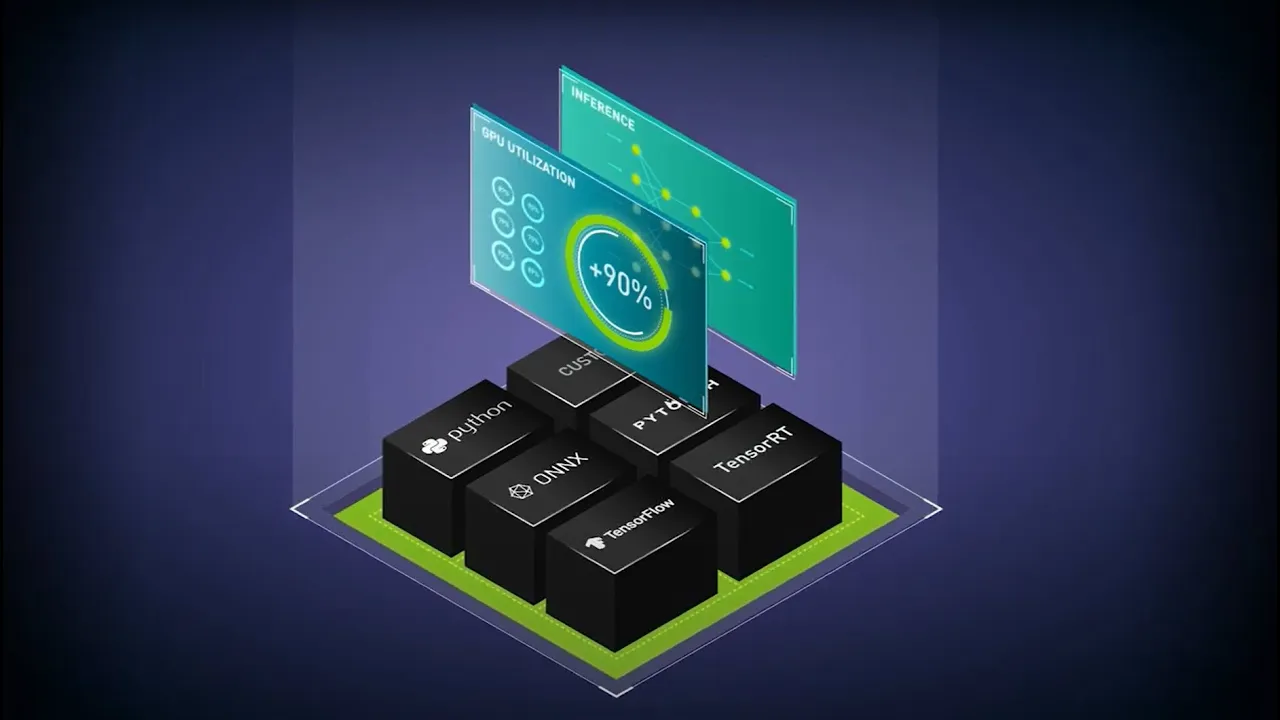

El soporte de NVIDIA Dynamo con todos los principales marcos, incluidos NVIDIA TensorRT-LLM, vLLM, SGLang, PyTorch y muchos más, garantiza la capacidad para implementar rápidamente nuevos modelos de IA generativa, independientemente de su backend.

Partners del ecosistema de Dynamo

Casos de uso

Implementación de IA con NVIDIA Dynamo

Descubra cómo puede impulsar la innovación con NVIDIA Dynamo.

-

Servicio de modelo de razonamiento

-

Escalado de IA de Kubernetes

-

Implementación de agentes de IA

-

Generación de código

Servir modelos de razonamiento

Los modelos de razonamiento generan más tokens para resolver problemas complejos, lo que aumenta los costes de inferencia. NVIDIA Dynamo optimiza estos modelos con características como el servicio desagregado. Este enfoque separa las fases computacionales de precargado y descodificación en GPU distintas, lo que permite a los equipos de inferencia de IA optimizar cada fase de forma independiente. El resultado es una mejor utilización de recursos, más consultas servidas por GPU y menores costes de inferencia. Cuando se combina con NVIDIA GB200 NVL72, NVIDIA Dynamo aumenta el rendimiento compuesto hasta 15 veces.

Escalado de IA de Kubernetes

A medida que los modelos de IA crecen en demasía para poder alojarse en un solo nodo, servirlos de forma eficiente se convierte en un desafío. La inferencia distribuida requiere la división de modelos en varios nodos, lo que añade complejidad en la orquestación, el escalado y la comunicación en entornos basados en Kubernetes. Garantizar que estos nodos funcionen como una unidad cohesiva, especialmente bajo cargas de trabajo dinámicas, exige una gestión cuidadosa. NVIDIA Dynamo simplifica esto al utilizar Grove, que se encarga de la programación, el escalado y el servicio sin problemas, para que pueda centrarse en la implementación de la IA, no en la gestión de la infraestructura.

Agentes de IA escalables

Los agentes de IA generan cantidades masivas de caché de KV al trabajar con varios modelos (LLM, sistemas de recuperación y herramientas especializadas) en tiempo real. Esta caché de KV a menudo excede la capacidad de la memoria de la GPU, lo que crea un cuello de botella para el escalado y el rendimiento.

Para superar las limitaciones de memoria de la GPU, el almacenamiento en caché de datos de KV en la memoria de host o el almacenamiento externo amplía la capacidad, lo que permite a los agentes de IA escalar sin restricciones. NVIDIA Dynamo simplifica esto con su KV Cache Manager e integraciones con herramientas de código abierto como LMCache, lo que garantiza una gestión eficiente de la caché y un rendimiento escalable de los agentes de IA.

Generación de código

La generación de código requiere a menudo un refinamiento iterativo para ajustar indicaciones, aclarar requisitos o depurar salidas basadas en las respuestas del modelo. Esta ida y vuelta requiere un recálculo del contexto con cada vuelta de usuario, lo que aumenta los costes de inferencia. NVIDIA Dynamo optimiza este proceso al permitir la reutilización del contexto.

El router compatible con LLM de NVIDIA Dynamo gestiona de forma inteligente la caché de KV en clústeres de GPU de varios nodos. Enruta las solicitudes en función de la superposición de caché y las dirige a las GPU con el mayor potencial de reutilización. Esto minimiza la computación redundante y garantiza un rendimiento equilibrado en implementaciones a gran escala.

Testimonios de clientes

Vea lo que dicen los líderes del sector sobre NVIDIA Dynamo

Cohere

"El escalado de modelos de IA avanzados requiere una sofisticada programación con varias GPU, una coordinación impecable y bibliotecas de comunicación de baja latencia que transfieran contextos de razonamiento a la perfección en toda la memoria y el almacenamiento. Esperamos que Dynamo nos ayude a ofrecer una experiencia de usuario de primer nivel a nuestros clientes empresariales".

Saurabh Baji, vicepresidente sénior de ingeniería de Cohere

Perplexity AI

"Al gestionar cientos de millones de solicitudes al mes, confiamos en las GPU y el software de inferencia de NVIDIA para ofrecer el rendimiento, la fiabilidad y la escala que exigen nuestra empresa y nuestros usuarios. Esperamos aprovechar Dynamo con sus capacidades mejoradas de servicio distribuido para impulsar aún más la eficiencia de la provisión de inferencia y satisfacer las exigencias de computación de los nuevos modelos de razonamiento de IA."

Denis Yarats, director de tecnología de Perplexity AI.

Together AI

"El escalado de modelos de razonamiento de forma rentable requiere nuevas técnicas de inferencia avanzadas, incluido el servicio desagregado y el enrutamiento consciente del contexto. Together AI ofrece un rendimiento líder en el sector utilizando nuestro motor de inferencia patentado. La apertura y la modularidad de NVIDIA Dynamo nos permitirán conectar a la perfección sus componentes a nuestro motor para servir más solicitudes al tiempo que optimizamos la utilización de recursos, lo que maximiza nuestra inversión en computación acelerada".

Ce Zhang, director de tecnología de Together AI.

Historias de clientes

Cómo los líderes del sector mejoran la implementación de modelos con la plataforma NVIDIA Dynamo

NVIDIA Blackwell Ultra ofrece un rendimiento hasta 50 veces mejor y un coste 35 veces menor para la IA de agentes

Diseñada para acelerar la próxima generación de IA de agentes, NVIDIA Blackwell Ultra ofrece un rendimiento de inferencia sin precedentes con un coste drásticamente inferior. Algunos proveedores de la nube, como Microsoft, CoreWeave y Oracle Cloud Infrastructure, están implementando sistemas NVIDIA GB300 NVL72 a escala para casos de uso de baja latencia y contexto largo, como codificación agentiva y asistentes de codificación.

Esto es posible gracias al diseño conjunto profundo en NVIDIA Blackwell, NVLink™ y NVLink Switch para escalar, NVFP4 para una exactitud de baja precisión, y NVIDIA Dynamo y TensorRT™ LLM para obtener velocidad y flexibilidad, así como el desarrollo con los entornos de trabajo de la comunidad SGLang, vLLM y otros.

Recursos

Lo último en inferencia de NVIDIA

-

Blogs

-

Sesiones

-

Formación

-

Vídeos

Próximos pasos

¿Listo para empezar?

¡Descárguelo en GitHub y únase a la comunidad!

Para desarrolladores

Explore todo lo necesario para comenzar a desarrollar con NVIDIA Dynamo, incluyendo la última documentación, tutoriales, blogs técnicos y mucho más.

Póngase en contacto

Hable con un especialista en productos de NVIDIA sobre cómo pasar de la fase piloto a la de producción con la seguridad, la estabilidad de las API y el soporte de NVIDIA AI Enterprise.