Inferencia de IA

NVIDIA Dynamo

Escale y ofrezca inferencia de IA de forma rápida.

Descripción General

El Sistema Operativo de la IA

Servir eficientemente a los modelos de lenguaje de vanguardia actuales a menudo requiere recursos que exceden la capacidad de una sola GPU, o incluso de un nodo completo, lo que hace que la implementación distribuida y de múltiples nodos sea esencial para la inferencia de IA.

NVIDIA Dynamo es un framework de servicio de inferencia distribuido de código abierto diseñado para implementar modelos en entornos de múltiples nodos a escala de centro de datos. Admite motores de inferencia de código abierto (como SGLang, NVIDIA TensorRT™ LLM y vLLM) y simplifica las complejidades del servicio distribuido al desagregar las fases de inferencia en diferentes GPU, enrutar de forma inteligente las solicitudes a la GPU apropiada para evitar la computación redundante y extender la memoria de GPU a niveles de almacenamiento rentables a través del almacenamiento en caché de datos.

Los microservicios de NVIDIA NIM incluirán las capacidades de NVIDIA Dynamo, lo que proporcionará una opción de implementación rápida y fácil. NVIDIA Dynamo también será compatible y estará disponible con NVIDIA AI Enterprise.

Una Mirada Más de Cerca a NVIDIA Dynamo

Framework de inferencia distribuido de baja latencia para escalar modelos de IA de razonamiento.

Evaluaciones de referencia independientes muestran que NVIDIA GB300 NVL72, combinado con NVIDIA Dynamo, mejora el rendimiento de los modelos de combinación de expertos (MoE) hasta 50 veces en comparación con los sistemas basados en NVIDIA Hopper™.

GB300 NVL72 conecta 72 GPU a través de NVIDIA NVLink™ de alta velocidad, lo que permite una comunicación de expertos de baja latencia crítica para los modelos de razonamiento de MoE. NVIDIA Dynamo mejora la eficiencia mediante la inferencia desagregada al dividir las fases de precargado y decodificación entre los nodos para lograr una optimización independiente. Juntos, GB300 NVL72 y NVIDIA Dynamo forman una pila de alto desempeño optimizada para la inferencia de MoE a gran escala.

Funciones

Explore las Funciones de NVIDIA Dynamo

Acelere la Inferencia Distribuida

NVIDIA Dynamo es totalmente de código abierto, lo que le brinda total transparencia y flexibilidad. Implemente NVIDIA Dynamo, contribuya a su crecimiento e intégrelo sin problemas en su pila existente.

¡Descúbralo en GitHub y únase a la comunidad!

Beneficios

Los Beneficios de NVIDIA Dynamo

Escale Sin Problemas Desde Una GPU a Miles de GPU

Optimice y automatice la configuración de clústeres de GPU con herramientas preconstruidas y fáciles de implementar y habilite el escalado automático dinámico con métricas específicas de LLM en tiempo real, lo que evita el aprovisionamiento excesivo o insuficiente de recursos de GPU.

Aumente la Capacidad de Servicio de Inferencia a la Vez que Reduce los Costos

Aproveche optimizaciones avanzadas de servicio de inferencia de LLM, como el servicio desagregado y el autoescalado consciente de la topología para aumentar la cantidad de solicitudes de inferencia atendidas sin comprometer la experiencia del usuario.

Prepare Su Infraestructura de IA para el Futuro y Evite Costosas Migraciones

El diseño abierto y modular le permite elegir fácilmente los componentes de servicio de inferencia que se adaptan a sus necesidades únicas, lo que garantiza la compatibilidad con su pila de IA existente y evita costosos proyectos de migración.

Acelere el Tiempo para Implementar Nuevos Modelos de IA en Producción

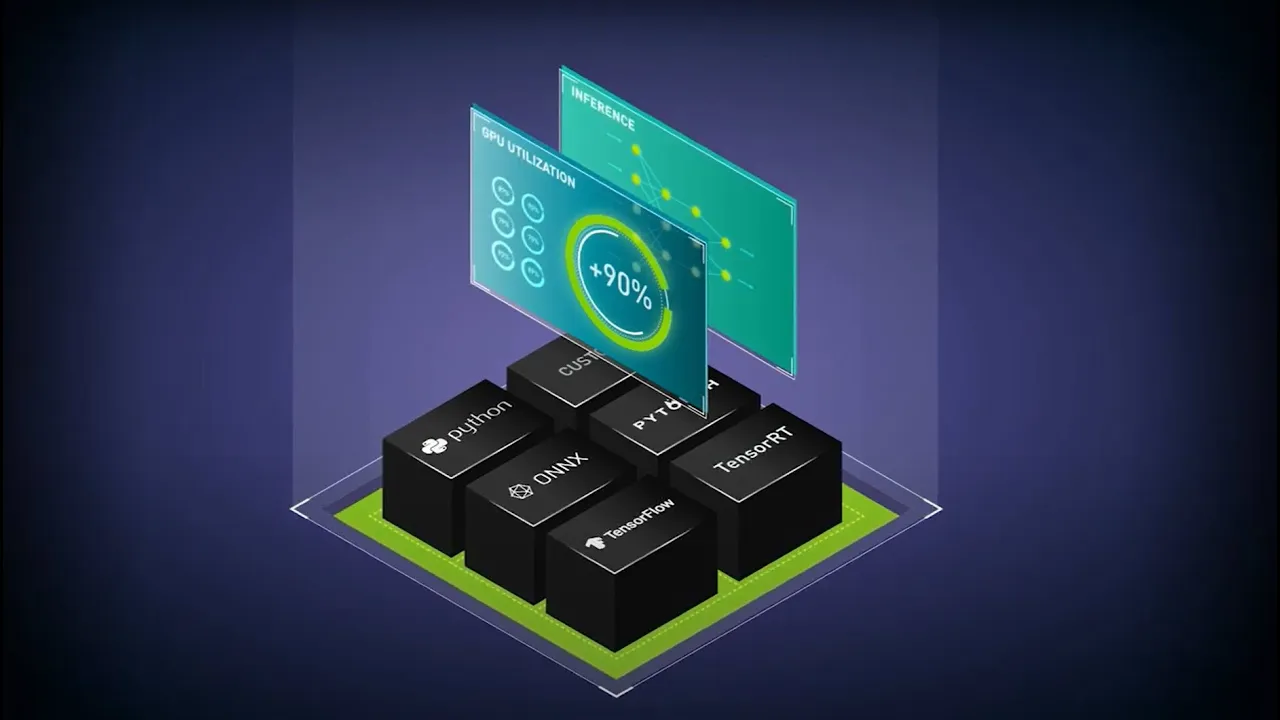

La compatibilidad de NVIDIA Dynamo con todos los principales frameworks (como NVIDIA TensorRT-LLM, vLLM, SGLang, PyTorch y más) garantiza su capacidad para implementar rápidamente nuevos modelos de IA generativa, independientemente de su backend.

Socios del Ecosistema Dynamo

Casos de Uso

Implementación de IA con NVIDIA Dynamo

Descubra cómo puede impulsar la innovación con NVIDIA Dynamo.

-

Servicio para Modelos de Razonamiento

-

Escalado de la IA de Kubernetes

-

Implementación de Agentes de IA

-

Generación de Código

Servicio para Modelos de Razonamiento

Los modelos de razonamiento generan más tokens para resolver problemas complejos, lo que aumenta los costos de inferencia. NVIDIA Dynamo optimiza estos modelos con funciones como el servicio desagregado. Este enfoque separa las fases computacionales del prellenado y la decodificación en GPU distintas, lo que permite a los equipos de inferencia de IA optimizar cada fase de forma independiente. El resultado es una mejor utilización de recursos, más consultas atendidas por GPU y menores costos de inferencia. Al combinarse con NVIDIA GB200 NVL72, NVIDIA Dynamo aumenta el desempeño de la composición hasta 15 veces.

Escalado de la IA de Kubernetes

A medida que los modelos de IA se vuelven demasiado grandes para caber en un solo nodo, brindarles servicio de manera eficiente se convierte en un desafío. La inferencia distribuida requiere dividir modelos en múltiples nodos, lo que agrega complejidad en la orquestación, el escalado y la comunicación en los entornos basados en Kubernetes. Garantizar que estos nodos funcionen como una unidad cohesiva, especialmente en cargas de trabajo dinámicas, exige una administración cuidadosa. NVIDIA Dynamo simplifica esto usando Grove, que maneja la programación, la escalabilidad y el servicio de manera fluida y eficiente para que usted pueda centrarse en implementar la IA, no en administrar su infraestructura.

Agentes de IA Escalables

Los agentes de IA generan cantidades masivas de caché de KV al trabajar con múltiples modelos (LLM, sistemas de recuperación y herramientas especializadas) en tiempo real. Esta caché de KV a menudo excede la capacidad de la memoria de GPU, lo que crea un cuello de botella para la escalabilidad y el desempeño.

Para superar las limitaciones de la memoria de GPU, el almacenamiento en caché de datos de KV en la memoria de host o el almacenamiento externo extiende la capacidad, lo que permite a los agentes de IA escalar sin restricciones. NVIDIA Dynamo simplifica esto con su KV Cache Manager y se integra con herramientas de código abierto como LMCache, lo que garantiza una administración de caché eficiente y un desempeño escalable de agentes.

Generación de Código

La generación de código a menudo requiere un refinamiento iterativo para ajustar indicaciones, aclarar requisitos o depurar salidas en función de las respuestas del modelo. Este proceso de ida y vuelta requiere recálculo de contexto con cada turno de usuario, lo que aumenta los costos de inferencia. NVIDIA Dynamo optimiza este proceso al permitir la reutilización de contexto.

El enrutador compatible con LLM de NVIDIA Dynamo administra inteligentemente la caché de KV en los clústeres de GPU de múltiples nodos. Enruta las solicitudes en función de la superposición de caché y las dirige a las GPU con el más alto potencial de reutilización. Esto minimiza la computación redundante y garantiza un desempeño equilibrado en implementaciones a gran escala.

Testimonios de Clientes

Vea lo que los Líderes de la Industria Tienen para Decir sobre NVIDIA Dynamo

Cohere

“El escalado de modelos de IA avanzados requiere programación sofisticada de múltiples GPU, coordinación sin problemas y bibliotecas de comunicación de baja latencia que transfieren contextos de razonamiento de forma fluida en la memoria y el almacenamiento. Esperamos que Dynamo nos ayude a ofrecer a nuestros clientes empresariales una experiencia de usuario de primer nivel”.

Saurabh Baji, Vicepresidente Sénior de Ingeniería de Cohere

Perplexity AI

“Al manejar cientos de millones de solicitudes cada mes, confiamos en las GPU y el software de inferencia de NVIDIA para ofrecer el desempeño, la confiabilidad y la escalabilidad que exigen nuestra empresa y los usuarios. Esperamos aprovechar Dynamo con sus capacidades de servicio distribuido mejoradas para impulsar aún más eficiencias en el servicio de inferencia y satisfacer las demandas de computación de los nuevos modelos de razonamiento de IA".

Denis Yarats, Director de Tecnología de Perplexity AI.

Together AI

“El escalado de modelos de razonamiento de manera rentable requiere nuevas técnicas avanzadas de inferencia, como el servicio desagregado y el enrutamiento consciente del contexto. Together AI proporciona un desempeño líder en la industria con nuestro motor de inferencia patentado. La apertura y modularidad de NVIDIA Dynamo nos permitirán conectar fácilmente sus componentes a nuestro motor para servir a más solicitudes y a la vez optimizar el uso de recursos, y así maximizar nuestra inversión en computación acelerada".

Ce Zhang, Director de Tecnología de Together AI.

Historias de Clientes

Cómo los Líderes de la Industria Están Mejorando la Implementación de Modelos con la Plataforma NVIDIA Dynamo

Recursos

Lo Último en Inferencia de NVIDIA

-

Blogs

-

Sesiones

-

Capacitación

-

Videos

Próximos Pasos

¿Todo Listo para Comenzar?

¡Descargue en GitHub y únase a la comunidad!

Para Desarrolladores

Explore todo lo que necesita para comenzar a desarrollar con NVIDIA Dynamo, incluida la documentación, los tutoriales, los blogs técnicos más recientes, etc.

Contáctenos

Hable con un especialista en productos NVIDIA sobre el paso de la fase de pruebas a la de producción con la seguridad, la estabilidad de las API y la asistencia de NVIDIA AI Enterprise.