概要

NVIDIA NeMo とは?

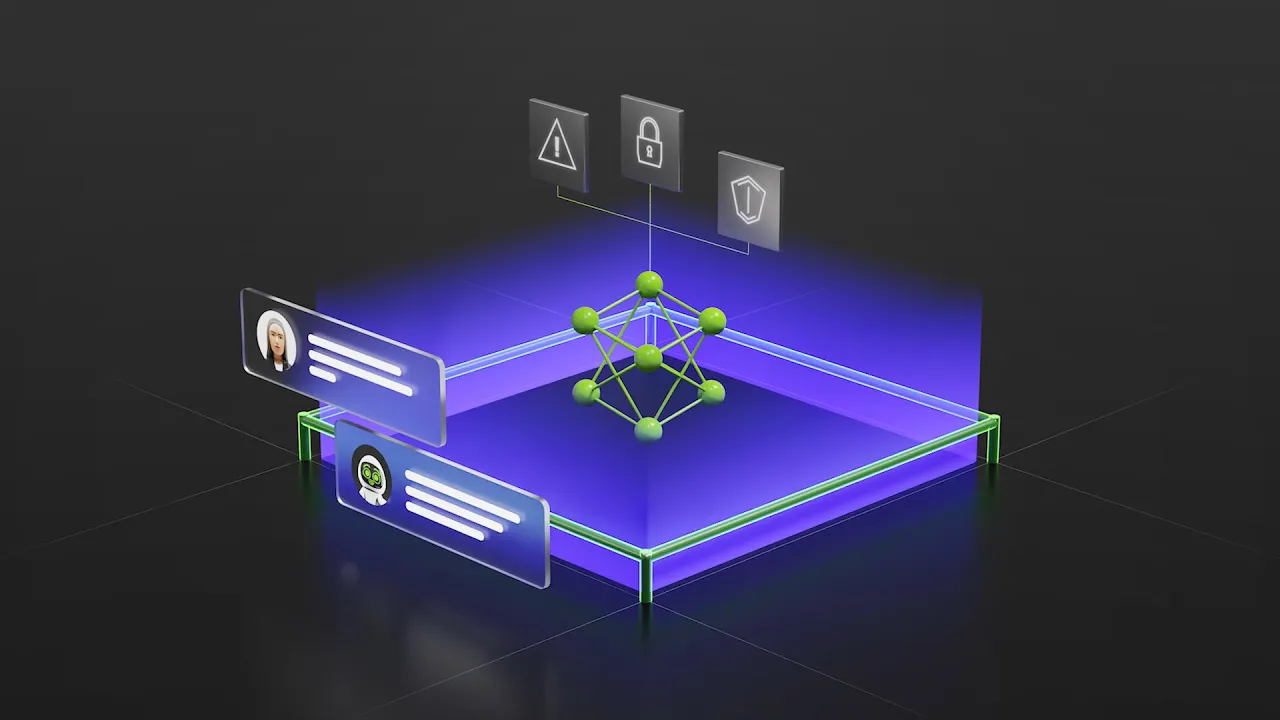

NVIDIA NeMo™ は、AI エージェントのライフサイクルを管理する包括的なツールキットです。これには、データ処理、データ生成、モデルのファインチューニングと評価、強化学習、音声、安全性、エージェントの可観測性を実現するオープン ライブラリとマイクロサービスが含まれています。NeMo を活用して、NVIDIA Nemotron™ などのオープンなモデルをカスタマイズし、ドメインのニーズとデータに合わせてカスタマイズされた本番環境グレードの特化型エージェント システムを構築してください。

既存の AI プラットフォームと統合し、クラウド、オンプレミス、ハイブリッド環境での導入をサポートします。

特長

AI エージェントのライフサイクル管理のためのツール

AI エージェントのライフサイクルは、本番環境アプリケーションにおける AI エージェントの開発と改善のためのエンドツーエンドのプロセスです。 NVIDIA NeMo は、このワークフローの各ステップを可能にするツールを提供しています。これにより、企業は強力で安全かつ継続的に学習する特化型エージェントを構築できます。

| 構築 | |

|---|---|

| AI 対応データの準備 既存のマルチモーダル データセットを開発パイプライン向けに高品質な AI 対応フォーマットに変換し、合成データを生成して重要なデータ ギャップを解消します。 |

|

| 適切なモデルの選択 ユース ケースに適したモデルを選択または構築: Nemotron の公開モデル、その他のオープンソースまたは独自のオプションから選択するか、あるいはゼロからトレーニングします。評価実行で検証し、必要に応じてファインチューニングします。 |

|

| AI エージェントの構築 組み込みのパフォーマンス分析、ボトルネック検出、評価主導の RL チューニング、および LangChain、LlamaIndex、その他のエージェント エコシステムとの相互運用性により、フレームワーク全体でエージェント ワークフローをプロファイリングおよび最適化します。 |

|

| デプロイ | |

| デプロイして最大のパフォーマンスを発揮し エージェントを本番環境向けに最適化し、高スループットで低レイテンシーの推論を実現することで、企業のニーズを満たすように拡張し、迅速かつ信頼性の高い応答を提供できるようにします。 |

|

| データに基づいた判断を徹底し、適切なガードレールを適用 検索拡張生成 (RAG) を使用して、安全性、コンプライアンス、コンテンツ モデレーションに適切なガードレールを適用しながら、エージェントの応答を信頼できる知識に結び付けます。 |

|

| 最適化 | |

| 監視とフィードバックの収集 エージェントがユーザーやその他のシステムと実世界で行うやりとりを追跡します。 パフォーマンスと精度を体系的に評価し、継続的に改善する機会を見つけます。 |

|

| データフライホイールを使用して継続的に改善します。 モニタリングで収集されたフィードバックとデータを活用してデータ駆動型のフライホイールを作成し、エージェントを反復的に再訓練して最適化し、長期間にわたり効果的であり続けるようにします。 |

|

ユース ケース

NeMo の使用事例

NVIDIA NeMo がどのように業界のユース ケースをサポートし、AI 開発を後押ししているかをご覧ください。

-

AI エージェント

-

エージェント型 AI 向け合成データ生成 (SDG)

-

AI アシスタント

-

エンタープライズ検索

-

コンテンツの生成

-

ヒューマノイド ロボット

AI エージェント

AI エージェントは、さまざまな業界におけるカスタマーサービスを変革しており、企業が顧客との対話を向上させ、高い解決率を実現し、さらに人間の担当者の生産性を高めることを支援しています。AI エージェントは、予測タスクの処理、推論と問題解決の処理、業界固有の用語の理解、データがどこにあるかにかかわらず、組織の知識ベースから関連情報を引き出すことができます。

エージェント型 AI の合成データ生成

専門化されたエージェント型 AI システムでは、実世界のソースから収集する際に時間がかかり、コストもかさむ大規模かつ高品質なデータセットが必要です。シミュレーションや生成 AI モデルを通じて作成された合成データは、プライバシー面の制約や品質の問題を抱えることなく、無制限のトレーニング シナリオを作成することで、このボトルネックを解消できます。 これにより、リーズニング LLM、マルチステップの意思決定者、マルチモーダル AI アシスタントの開発が迅速化します。

エンタープライズ検索

企業は、PDF、レポート、プレゼンテーションなど、それぞれにテキスト、画像、グラフ、表を含む何兆ものドキュメントを毎年生成していますが、それらは分断されたシステムに分散して保存されています。AI を活用したエンタープライズ検索は、分散したデータを統合されたナレッジ ベースへと変換し、従業員が自然言語を使って即座に洞察を引き出せるようにするとともに、より低コストで迅速な意思決定を実現します。

コンテンツの生成

生成 AI を使用すると、企業のその分野の専門知識や独自の IP に基づいた関連性が高くカスタマイズされた、正確なコンテンツを生成することができます。

ヒューマノイド ロボット

ヒューマノイド ロボットは、既存の人間中心の都市や産業の作業空間に素早く適応し、退屈で反復的な、または肉体的に要求の高いタスクに取り組むように設計されています。 その汎用性により、工場のフロアから医療施設まで、さまざまな場所で人間を支援し、自動化によって人手不足の緩和に貢献しています。

Apptronik

利点

エージェント型 AI 向け NVIDIA NeMo の利点を探る

包括的なモジュール型 AI エージェント スイート

相互運用可能なエンタープライズ グレードのソフトウェア スイートにより、データのキュレーションと事後学習から評価、ガードレール、可観測性、継続的な最適化に至るまで、エージェントのライフサイクル全体を管理します。

大規模な高速化

エンタープライズ データを使用して、高スループットなエージェント ワークロード向けの GPU で高速化されたトレーニング、推論、マルチノード スケーリング、コスト効率に優れた最適化により、データ フライホイールをデプロイおよび拡張します。

ROI の向上

大規模言語モデル (LLM)、視覚言語モデル (VLM)、ビデオ AI、スピーチ AI を迅速にトレーニング、カスタマイズ、大規模にデプロイし、ソリューションまでの時間を短縮し、ROI を向上させます。

高速化されたパフォーマンス

機密データの保護、ポリシーとプロンプト ガードレールの適用、モデル検証、脆弱性の継続的な検知。 NVIDIA AI Enterprise により、クラウド、データセンター、エッジ全体でエンタープライズ グレードのサポートと安定性を備えた安全なデプロイが可能になります。

導入事例

業界のリーダーが NeMo でイノベーションを推進する方法

採用した企業

全産業における主要な採用企業

-

顧客

-

パートナー

関連情報

最新の NVIDIA NeMo リソース

-

ブログ

-

セッション

-

トレーニング

-

動画

次のステップ

さっそく始めませんか?

適切なツールとテクノロジを活用して、生成 AI モデルを開発から本番利用へと移行しましょう。

開発者向け

NVIDIA NeMo を使用して開発を始めるにあたって、必要なものすべて (最新のドキュメント、チュートリアル、技術ブログなど) をご覧ください。

お問い合わせ

試作から本番環境への移行については、NVIDIA の製品スペシャリストにご相談ください。NVIDIA AI Enterprise が提供するセキュリティの安心感、API の安定性、サポートを活用することができます。