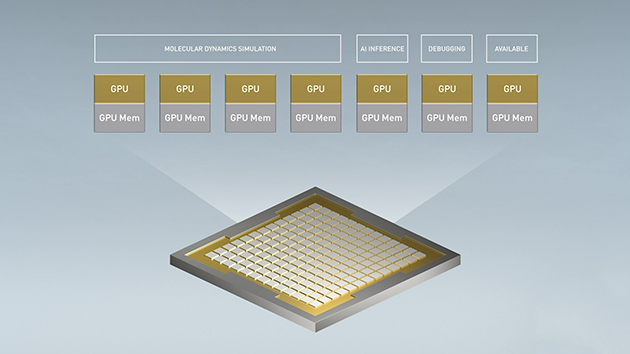

Porta le prestazioni accelerate in ogni carico di lavoro aziendale con la GPU NVIDIA A30 Tensor Core. Con i Tensor Core dell'architettura NVIDIA Ampere e Multi-Instance GPU (MIC), offre accelerazioni in modo sicuro su diversi carichi di lavoro, tra cui l'inferenza con IA su larga scala e le applicazioni HPC. Combinando una larghezza di banda di memoria veloce e un basso consumo energetico in un fattore di forma PCIe, ottimale per i server mainstream, la A30 consente di creare un data center elastico e offre il massimo valore per le aziende.

GPU NVIDIA A30 Tensor Core

Accelerazione di calcolo versatile per i server aziendali tradizionali.