NVIDIA NVLink e NVLink Switch

Scale-up networking fabric with high-bandwidth GPU-to-GPU communications for AI training, inference, and other demanding rack-scale GPU-accelerated workloads.

La necessità di un'interconnessione scalabile ancora più veloce

Per ottenere le massime prestazioni per gli ultimi modelli IA sono necessarie comunicazioni da GPU a GPU fluide e ad alto throughput nell'intero rack server. Con una bassa latenza, un'enorme larghezza di banda di rete e la connettività all-to-all, le tecnologie NVIDIA NVLink™ di sesta generazione e NVLink Switch sono progettate per accelerare l'addestramento e l'inferenza per carichi di lavoro di ragionamento e IA agentica.

Massimizzare il throughput e l'uptime di sistema con NVIDIA NVLink

La tecnologia NVLink di sesta generazione consente 3,6 TB/s di larghezza di banda per GPU per la piattaforma NVIDIA Rubin, il doppio rispetto alla generazione precedente e oltre 14 volte la larghezza di banda per GPU dello standard PCIe Gen6. Le architetture rack scalabili come NVIDIA Vera Rubin NVL72 collegano 72 GPU in una topologia all-to-all per un totale di 260 TB/s, rendendo possibile una larghezza di banda enorme per le comunicazioni all-to-all necessarie per l'addestramento e l'inferenza delle principali architetture di modelli mixture-of-experts. La tecnologia NVLink 6 Switch introduce inoltre nuove funzionalità di gestione e resilienza progettate per massimizzare l'uptime di sistema, tra cui la resilienza del piano di controllo, la capacità di funzionare con un rack parzialmente popolato e la sostituzione a caldo dei vassoi per switch.

Prestazioni di NVLink su larga scala

La tecnologia NVIDIA NVLink di sesta generazione su NVIDIA Rubin raddoppia la larghezza di banda di comunicazione da GPU a GPU rispetto alla generazione precedente, per un addestramento e un'inferenza più rapidi con le ultime architetture dei modelli IA.

Aumenta il throughput di ragionamento con NVLink Communications

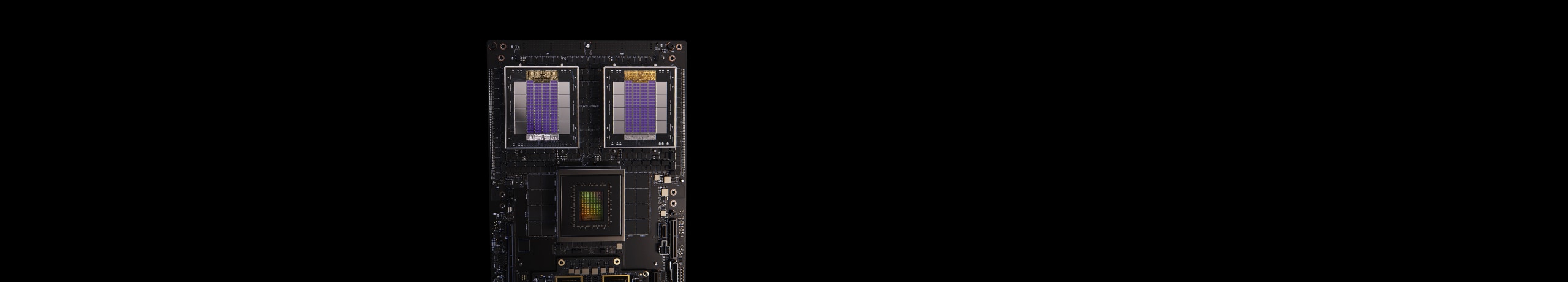

Collega le GPU con NVIDIA NVLink e NVLink Switch

L'interconnessione bidirezionale e diretta da GPU a GPU da 3,6 TB/s NVLink scala l'input e l'output (IO) multi-GPU all'interno dei server. I chip NVIDIA NVLink Switch connettono più NVLink per fornire una comunicazione GPU completa, alla massima velocità NVLink, nell'intero rack.

Per consentire operazioni collettive ad alta velocità, ogni switch NVLink dispone di motori per il protocollo NVIDIA Scalable Hierarchical Aggregation and Reduction Protocol (SHARP)™ per la riduzione delle emissioni nella rete e l'accelerazione multicast.

Accelera il ragionamento durante il test per modelli di trilioni di parametri con il sistema NVLink Switch

Con NVLink Switch, le connessioni NVLink possono essere estese su più nodi per creare un cluster GPU fluido, a elevata larghezza di banda e multi-nodo, formando efficacemente una GPU di dimensioni data center. Lo switch NVIDIA NVLink consente di ottenere 260 TB/s di larghezza di banda GPU in un solo NVIDIA Vera Rubin NVL72 per il parallelismo di modelli di grandi dimensioni. I cluster multi-server con NVLink scalano le comunicazioni delle GPU in equilibrio grazie alla maggiore capacità di calcolo, consentendo così a NVIDIA Vera Rubin NVL72 di supportare un numero di GPU 9 volte superiore rispetto a un singolo sistema a otto GPU.

NVIDIA NVLink Fusion

NVIDIA NVLink Fusion rende possibile una scalabilità delle prestazioni IA mai vista prima per il calcolo personalizzato, consentendo ai fornitori di servizi hyperscale di creare un'infrastruttura IA comune con la tecnologia NVIDIA NVLink e l'architettura rack-scale.

Scalabilità da enterprise a esascala

Connessione piena per prestazioni senza pari

Il chip NVLink Switch su Vera Rubin NVL72 consente di utilizzare 72 GPU completamente connesse in un fabric di calcolo non bloccante. Lo switch NVLink interconnette ogni coppia di GPU a una velocità incredibile di 3,6 TB/s. Supporta la comunicazione all-to-all completa. Le 72 GPU su Vera Rubin NVL72 possono essere usate come un singolo acceleratore ad alte prestazioni con fino a 3,6 exaFLOPS di potenza di calcolo IA.

La piattaforma per IA e HPC più potente.

NVLink e NVLink Switch sono fondamenti essenziali della soluzione completa per data center NVIDIA che integra hardware, rete, software, librerie, modelli e applicazioni IA ottimizzati dalla suite software NVIDIA AI Enterprise e dal catalogo NVIDIA NGC™. Piattaforma IA e HPC completa più potente, consente ai ricercatori di fornire risultati in tempo reale e distribuire soluzioni nell'ambiente di produzione in modo scalabile, generando un'accelerazione senza precedenti su ogni ordine di grandezza.

Specifiche

-

NVLink

-

NVLink Switch

| Quarta generazione | Quinta generazione | Sesta generazione | |

|---|---|---|---|

| Banda NVLink per GPU | 900 GB/s | 1.800 GB/s | 3.600 GB/s |

| Numero massimo di link per GPU | 18 | 18 | 36 |

| Architetture NVIDIA supportate | architettura NVIDIA Hopper™ | dell'architettura NVIDIA Blackwell | NVIDIA Rubin Piattaforma |

| NVLink 4 Switch | NVLink 5 Switch | NVLink 6 Switch | |

|---|---|---|---|

| Domini GPU NVLink | 8 | 8 |72 | 8 |72 |

| Larghezza di banda Switch NVLink da GPU-GPU | 900 GB/s | 1.800 GB/s | 3.600 GB/s |

| Banda totale aggregata | 7,2 TB/s | 130 TB/s (NVL72) | 260 TB/s (NVL72) |

| Architetture NVIDIA supportate | Architettura NVIDIA Hopper™ | Architettura NVIDIA Blackwell | NVIDIA Rubin Piattaforma |

Specifiche preliminari, soggette a modifica.

NVIDIA Blackwell Ultra offre prestazioni fino a 50 volte migliori e costi 35 volte inferiori per l'IA per agenti

Progettata per accelerare la nuova generazione di IA per agenti, NVIDIA Blackwell Ultra offre prestazioni di inferenza rivoluzionarie con costi notevolmente inferiori. I fornitori di cloud come Microsoft, CoreWeave e Oracle Cloud Infrastructure stanno distribuendo sistemi NVIDIA GB300 NVL72 su larga scala per casi d'uso a bassa latenza e con contesti estesi, come la codifica agentica e gli assistenti di codifica.

Ciò è reso possibile dalla profonda co-progettazione tra NVIDIA Blackwell, NVLink™ e NVLink Switch per la scalabilità, NVFP4 per la precisione a bassa latenza e NVIDIA Dynamo e TensorRT™ LLM per la velocità e la flessibilità, nonché dallo sviluppo con i framework della community SGLang, vLLM e molto altro ancora.

Scopri tutto sulla piattaforma NVIDIA Rubin.