NVIDIA NeMo

Una suite software completa per creare, monitorare e ottimizzare gli agenti IA durante tutto il loro ciclo di vita su scala aziendale.

Panoramica

Che cos'è NVIDIA NeMo?

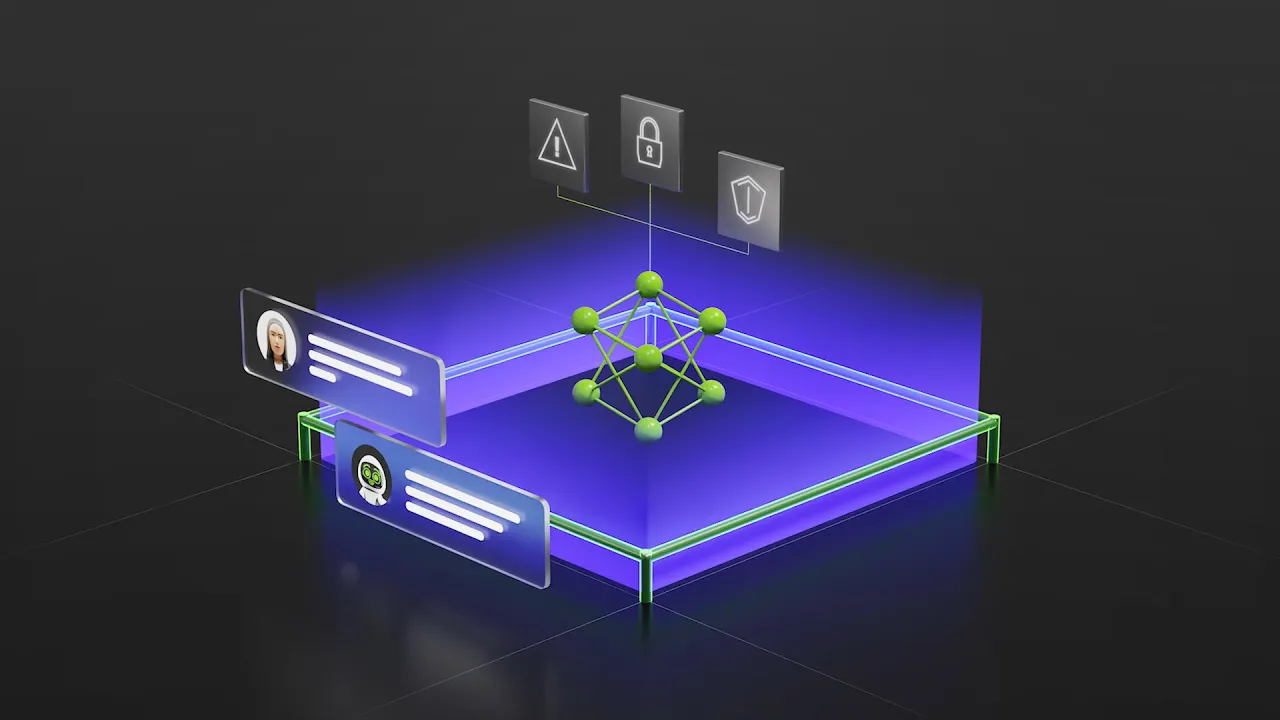

NVIDIA NeMo™ è un toolkit completo per la gestione del ciclo di vita degli agenti IA. Include librerie aperte e microservizi per l'elaborazione dei dati, la generazione di dati, l'ottimizzazione e la valutazione dei modelli, l'apprendimento per rinforzo, la voce, la sicurezza e l'osservabilità degli agenti. Usa NeMo per personalizzare NVIDIA Nemotron™ e altri modelli per creare sistemi agentici specializzati e di grado produttivo su misura per le esigenze e i dati del tuo dominio.

Si integra con le piattaforme IA esistenti e supporta le distribuzioni cloud, on-premise e ibride.

Funzionalità

Strumenti per la gestione del ciclo di vita degli agenti IA

Il ciclo di vita degli agenti IA è un processo completo per sviluppare e migliorare gli agenti IA nelle applicazioni di produzione. NVIDIA NeMo fornisce strumenti che rendono possibile ogni fase di questo flusso di lavoro, in modo che le aziende possano creare agenti potenti, sicuri e in grado di apprendere continuamente.

| Crea | |

|---|---|

| Prepara dati pronti per l'IA. Elabora i set di dati multimodali esistenti in formati di alta qualità e pronti per l'IA per le pipeline di sviluppo e genera dati sintetici per colmare le lacune critiche nei dati. |

|

| Seleziona il modello giusto Scegli o crea modelli adatti al caso d'uso: scegli tra i modelli Nemotron, le altre opzioni aperte o proprietarie oppure addestra il tuo modello da zero. Convalida con esecuzioni di valutazione e ottimizza secondo necessità. |

|

| Crea il tuo agente IA e ottimizza i flussi di lavoro agentici nei framework, con analisi delle prestazioni integrata, rilevamento dei colli di bottiglia, ottimizzazione RL basata sulla valutazione e interoperabilità con LangChain, LlamaIndex e altri ecosistemi per agenti. |

|

| Distribuisci | |

| Distribuire il tuo agente con le massime prestazioni Ottimizza il tuo agente per la produzione con inferenza ad alto throughput e a bassa latenza, garantendo la scalabilità per soddisfare le esigenze aziendali e fornire risposte rapide e affidabili. |

|

| Fai affidamento sui dati e applica i guardrail Usa la tecnologia RAG per basare le risposte degli agenti su conoscenze affidabili, applicando al contempo misure di sicurezza e conformità e moderando i contenuti. |

|

| Ottimizza | |

| Monitora e raccogli i feedback Monitora le interazioni reali dell'agente con gli utenti e gli altri sistemi. Valuta sistematicamente le sue prestazioni e la sua precisione, trovando opportunità per migliorare continuamente. |

|

| Migliora continuamente con i volani di dati Utilizza il feedback e i dati raccolti dal monitoraggio per creare un volano basato sui dati, riaddestrando iterativamente l'agente per ottimizzare continuamente e rimanere efficace nel tempo. |

|

Casi d'uso

Come viene utilizzato NeMo

Scopri come NVIDIA NeMo supporta i casi d'uso del settore e accelera lo sviluppo dell'IA.

-

Agenti IA

-

SDG per l'IA per agenti

-

Assistente IA

-

Recupero delle informazioni

-

Generazione di contenuti

-

Robot umanoide

Agenti IA

Gli agenti IA stanno trasformando il servizio clienti in tutti i settori, aiutando le aziende a migliorare le conversazioni con i clienti, raggiungere tassi di risoluzione elevati e aumentare la produttività dei responsabili umani. Gli agenti IA possono gestire compiti predittivi, ragionare e risolvere problemi, essere addestrati a comprendere termini specifici del settore e ricavare informazioni pertinenti dalle knowledge base di un'organizzazione, ovunque tali dati risiedano.

Generazione di dati sintetici per l'IA per agenti

I sistemi specializzati per agenti richiedono set di dati di grandi dimensioni e di alta qualità, lenti e costosi da raccogliere da fonti del mondo reale. I dati sintetici creati attraverso simulazioni o modelli di IA generativa possono eliminare questo collo di bottiglia creando scenari di addestramento illimitati senza restrizioni di privacy o problemi di qualità. Ciò consente uno sviluppo più rapido di LLM orientati al ragionamento, di decisori a più fasi e di assistenti IA multimodali.

Assistente IA

Le aziende stanno distribuendo assistenti IA per rispondere in modo efficiente alle domande di milioni di clienti e dipendenti 24 ore su 24. Grazie ai microservizi NVIDIA NIM personalizzati per LLM, RAG, IA per parlato e traduzione, questi compagni di team IA offrono risposte vocali immediate e accurate, anche in presenza di rumore di fondo, scarsa qualità sonora e diversi dialetti e accenti.

Ricerca aziendale

Le aziende generano trilioni di documenti ogni anno, tra cui PDF, report, presentazioni, ciascuno contenente testi, immagini, grafici e tabelle, distribuiti su sistemi disconnessi. La ricerca aziendale basata sull'IA trasforma questi dati sparsi in una knowledge base unificata, consentendo ai dipendenti di estrarre istantaneamente insight utilizzando il linguaggio naturale e di prendere decisioni più rapide con costi inferiori.

Generazione di contenuti

L'IA generativa consente di generare contenuti altamente pertinenti, personalizzati e accurati, basati sulle competenze di dominio e sulla proprietà intellettuale proprietaria dell'azienda.

Robot umanoide

I robot umanoidi vengono progettati per adattarsi rapidamente agli ambienti di lavoro urbani e industriali esistenti, svolgendo compiti noiosi, ripetitivi o fisicamente impegnativi. Grazie alla loro versatilità, vengono impiegati in luoghi di natura differente, dalle fabbriche alle strutture sanitarie, dove stanno assistono gli esseri umani e contribuiscono ad alleviare la carenza di manodopera con l'automazione.

Apptronik

Vantaggi

Scopri i vantaggi di NVIDIA NeMo per l'IA per agenti

Suite completa e modulare di agenti IA

Gestisci il ciclo di vita completo degli agenti, dalla selezione dei dati e il post-addestramento alla valutazione, i guardrail, l'osservabilità e l'ottimizzazione continua utilizzando una suite software interoperabile di livello aziendale.

Accelerare su larga scala

Distribuisci e scala i volani di dati utilizzando i dati aziendali, con addestramento accelerato da GPU, inferenza, scalabilità multi-nodo e ottimizzazione conveniente per carichi di lavoro di agenti ad alto throughput.

ROI aumentato

Crea, personalizza e distribuisci sistemi agentici specializzati in meno tempo, riducendo i tempi di produzione e massimizzando il ritorno sugli investimenti in IA.

Sicuro e pronto per la produzione

Proteggi i dati sensibili, applica le politiche e i guardrail, convalida i modelli e rileva continuamente le vulnerabilità. Distribuisci in modo sicuro con un supporto e una stabilità di livello aziendale nel cloud, nei data center e nell'edge con NVIDIA AI Enterprise.

Testimonianze dei clienti

Come i leader del settore stanno guidando l'innovazione con NeMo

Utilizzatori

Principali utilizzatori in tutti i settori

-

Clienti

-

Partner

Risorse

Le ultime novità nelle risorse NVIDIA NeMo

-

Blog

-

Sessioni

-

Formazione

-

Video

Prossimi passi

Vuoi iniziare?

Utilizza gli strumenti e le tecnologie giusti per portare le tue applicazioni di IA per agenti dallo sviluppo alla produzione.

Per gli sviluppatori

Scopri tutto ciò di cui hai bisogno per iniziare a sviluppare con NVIDIA NeMo, tra cui la documentazione più recente, i tutorial, i blog tecnici e altro ancora.

Contattaci

Parla con uno specialista di prodotto NVIDIA per passare dal progetto pilota alla produzione grazie alla sicurezza, alla stabilità delle API e al supporto forniti con NVIDIA AI Enterprise.