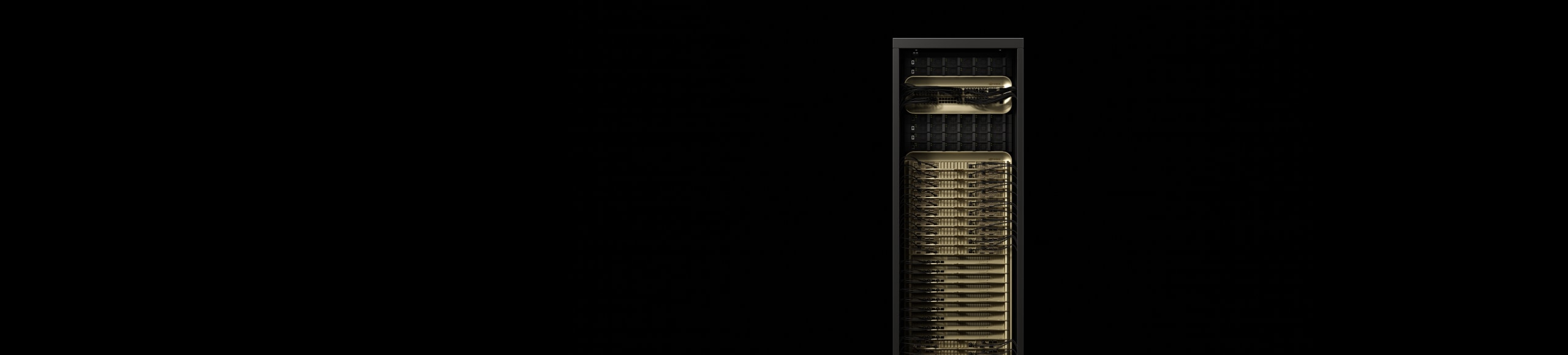

NVIDIA GB200 NVL72

Impulsamos la nueva era de la computación.

Descripción general

Descubrir modelos de billones de parámetros en tiempo real

NVIDIA GB200 NVL72 conecta 36 CPU Grace y 72 GPU Blackwell en un diseño a escala de bastidor refrigerado por líquido. Cuenta con un dominio NVIDIA NVLink™ de 72 GPU que actúa como una única GPU masiva y proporciona una inferencia de LLM en tiempo real 30 veces más rápida para billones de parámetros.

El GB200 Grace Blackwell Superchip es un componente clave del NVIDIA GB200 NVL72, que conecta dos GPU NVIDIA Blackwell Tensor Core de alto rendimiento y una CPU NVIDIA Grace™ mediante la interconexión NVLink-C2C a las dos GPU Blackwell.

Aspectos destacados

Impulsar la IA de próxima generación y la computación acelerada

Inferencia de LLM y eficiencia energética: TTL= 50 milisegundos (ms) en tiempo real, FTL= 5 s, 32 768 entradas/1024 salidas, NVIDIA HGX™ H100 escalada sobre InfiniBand (IB) frente a GB200 NVL72, entrenamiento de HGX H100 de 4096x MOE 1.8T escalada sobre IB frente a GB200 NVL72 de 456x escalada sobre IB. Tamaño del clúster: 32 768

Una carga de trabajo de agregación y unión a bases de datos con compresión Snappy/Deflate derivada de la consulta TPC-H Q4. Implementaciones de consulta personalizadas para una sola GPU x86, H100 y una sola GPU de GB200 NLV72 frente a Intel Xeon 8480+

Rendimiento previsto sujeto a cambios.

NVIDIA GB200 NVL4

NVIDIA GB200 NVL4 descubre el futuro de la HPC y la IA convergentes, ofreciendo un rendimiento revolucionario a través de un puente que conecta cuatro GPU NVIDIA NVLink Blackwell unificadas con dos CPU Grace a través de la interconexión NVLink-C2C. Compatible con los servidores modulares NVIDIA MGX™ refrigerados por líquido, ofrece hasta 2 veces más rendimiento para la computación científica, la IA para la formación científica y las aplicaciones de inferencia que la generación anterior.

Características

Technological Breakthroughs

Fábrica de IA para la nueva revolución industrial

NVIDIA Mission Control

NVIDIA Mission Control potencia todos los aspectos de las operaciones de fábrica de IA NVIDIA GB200 NVL72, desde la orquestación de cargas de trabajo en el dominio NVLink de 72 GPU hasta la integración con las instalaciones. Aporta agilidad instantánea para la inferencia y el entrenamiento, al tiempo que ofrece inteligencia de pila completa para la resiliencia de la infraestructura. MIssion Control permite que todas las empresas puedan ejecutar la IA con eficiencia a hiperescala, lo que acelera la experimentación con IA.

Especificaciones

Especificaciones de GB200 NVL72¹

| GB200 NVL72 | GB200 Grace Blackwell Superchip | |

| Configuración | 36 CPU Grace | 72 GPU Blackwell | 1 CPU Grace | 2 GPU Blackwell |

| Tensor Core de NFP42 | 1440 | 720 PFLOPS | 40 | 20 PFLOPS |

| Tensor Core de FP8/FP62 | 720 PFLOPS | 20 PFLOPS |

| Tensor Core de INT82 | 720 POPS | 20 POPS |

| Tensor Core de FP16/BF162 | 360 PFLOPS | 10 PFLOPS |

| Tensor Core de TF32 | 180 PFLOPS | 5 PFLOPS |

| FP32 | 5760 TFLOPS | 160 TFLOPS |

| Tensor Core de FP64/FP64 | 2880 TFLOPS | 80 TFLOPS |

| Memoria GPU | Ancho de banda | HBM3E de 13,4 TB | 576 TB/s | 372 GB HBM3E | 16 TB/s |

| Ancho de banda NVLink | 130 TB/s | 3,6 TB/s |

| Recuento de núcleos de CPU | 2592 núcleos Arm® Neoverse V2 | 72 núcleos Arm® Neoverse V2 |

| Memoria GPU | Ancho de banda | 17 TB LPDDR5X | 14 TB/s | LPDDR5X de 480 GB | 512 GB/s |

|

1. Especificación escasa | densa. |

||

NVIDIA GB300 NVL72

La NVIDIA GB300 NVL72 cuenta con una arquitectura totalmente refrigerada por líquido y a escala de bastidor que integra 72 GPU NVIDIA Blackwell Ultra y 36 CPU NVIDIA Grace™ basadas en Arm® en una única plataforma, diseñada específicamente para tareas de inferencia y razonamiento de IA a escala de tiempo de prueba. Las fábricas de IA aceleradas por la GB300 NVL72, que aprovechan NVIDIA Quantum-X800 InfiniBand o Spectrum-X Ethernet, ConnectX-8 SuperNIC y la gestión de NVIDIA Mission Control, ofrecen un aumento general de hasta 50 veces en el rendimiento de salida de fábrica de IA en comparación con las plataformas basadas en NVIDIA Hopper.