Inferência de IA Mais Rápida e Precisa

Promova um desempenho inovador com suas aplicações e serviços habilitados para IA.

A inferência é onde a IA fornece resultados, impulsionando a inovação em todos os setores. Os modelos de IA estão se expandindo rapidamente em tamanho, complexidade e diversidade, ampliando os limites do que é possível. Para o uso bem-sucedido da inferência de IA, as empresas e os engenheiros de MLOps precisam de uma abordagem full-stack que dê suporte ao ciclo de vida da IA de ponta a ponta e de ferramentas que permitam às equipes atingir seus objetivos.

Implemente Aplicações de IA de Última Geração com a Plataforma de Inferência de IA da NVIDIA

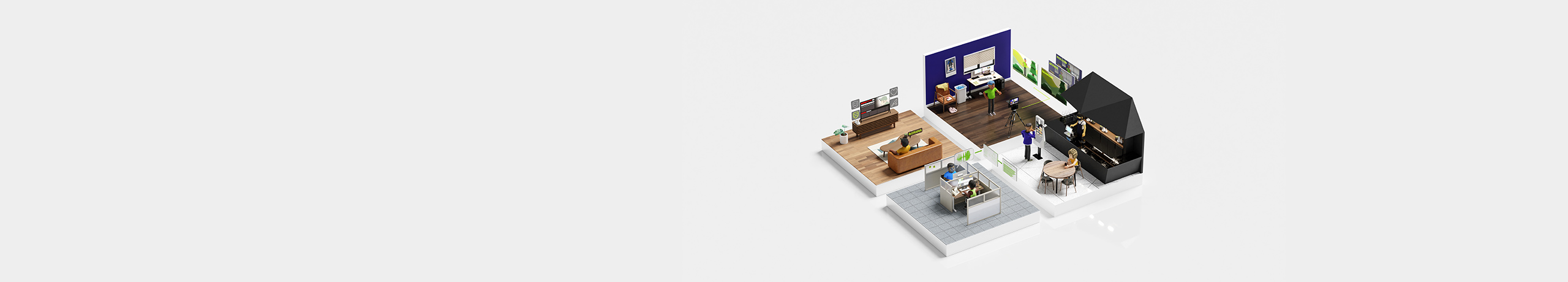

A NVIDIA oferece um stack completo de produtos, infraestrutura e serviços que proporcionam desempenho, eficiência e capacidade de resposta essenciais para potencializar a próxima geração de inferência de IA na nuvem, no data center, no edge da rede e em dispositivos embarcados. Ela foi projetada para engenheiros de MLOps, cientistas de dados, desenvolvedores de aplicações e engenheiros de infraestrutura de software com diversos níveis de conhecimento e experiência em IA.

A abordagem arquitetônica full-stack da NVIDIA garante que as aplicações habilitadas para IA sejam implementadas com desempenho ideal, menos servidores e menos energia, resultando em insights mais rápidos com custos significativamente mais baixos.

O NVIDIA AI Enterprise, uma plataforma de inferência de nível empresarial, inclui o melhor software de inferência, gerenciamento confiável, segurança e estabilidade de API para garantir desempenho e alta disponibilidade.

Explore os Benefícios

A Plataforma Completa de Inferência de IA da NVIDIA

Software de Inferência de IA da NVIDIA

O NVIDIA AI Enterprise consiste em Micro Serviços de Inferência NVIDIA (NIM), Servidor de Inferência NVIDIA Triton™, NVIDIA® TensorRT™ e outras ferramentas para simplificar a construção, o compartilhamento e a implantação de aplicações de IA. Com suporte, estabilidade, capacidade de gerenciamento e segurança de nível empresarial, as empresas podem acelerar o tempo de obtenção de valor e, ao mesmo tempo, eliminar o tempo de inatividade não planejado.

Infraestrutura de Inferência de IA da NVIDIA

Dê Uma Olhada na Inferência de IA em Todos os Setores

Mais Recursos

Mantenha-se atualizado sobre as últimas notícias sobre inferência de IA da NVIDIA.