가상 어시스턴트, 디지털 아바타, 챗봇과 같은 대화형 AI 애플리케이션은 인간과 기계의 자연스럽고 개인화된 대화로 향하는 혁신의 길을 닦고 있습니다. 그러나 엄격한 정확도와 지연 시간 요구 사항에 직면해 있습니다. NVIDIA의 대화형 AI 플랫폼을 통해 개발자는 매우 정확하고 실시간 상호 작용의 속도인 300밀리초보다 훨씬 빨리 응답하는 최첨단 애플리케이션을 신속하게 구축하고 배포할 수 있습니다.

대화형 AI

음성 인식에서 언어 이해 및 음성 합성에 이르는 전체 파이프라인 가속화

대화형 AI의 이점

에이전트 효율성

고객의 발화를 실시간으로 문자화하고, 분석하고, 고객 문의를 신속하게 해결하기 위한 추천 정보를 제공하여 콜센터 상담원을 지원합니다.

디지털 접근성

청각 장애가 있는 사람이 오디오 콘텐츠를 더 쉽게 소비하고, 언어 장애가 있는 사람이 자신을 더 쉽게 표현할 수 있도록 지원합니다.

고가용성

챗봇과 가상 어시스턴트를 사용하여 상담원의 정상 업무 시간이 아닐 때도 고객 문의를 해결하고 유용한 정보를 제공합니다.

실감 나는 경험

실시간 자막, 표현력이 뛰어난 합성 음성 생성, 고객 선호도 파악과 같은 기능을 통해 실감 나는 경험을 제공합니다.

다양한 산업에서의 대화형 AI

금융 서비스

사기 행위 탐지는 금융 서비스 업계의 모든 조직에서 매우 중요합니다. 챗봇은 금액과 위치를 포함한 거래 패턴을 식별하고 상호작용을 개인화하여 탐지를 지원할 수 있습니다. 대화형 AI는 상담원을 지원하고 통화 내용을 문자화하여 통화 커버리지를 높이는 용도로도 사용할 수 있습니다.

통신

통신 산업을 생각할 때 가장 먼저 떠오르는 문제 중 하나는 콜센터입니다. 콜센터는 모든 통신 비즈니스의 핵심이며 대화형 AI는 상담원 지원, 가상 상담원, 감정 분석 등에 대한 인사이트 추출과 같이 많은 애플리케이션을 가속화하는 데 도움이 될 수 있습니다.

소비자 서비스

대화형 AI는 회의 요약 작성 및 후속 회의 예약부터 가상 회의 중 실시간 자막 생성에 이르기까지 소비자 서비스 업계의 여러 프로세스를 개선할 수 있습니다. 또한 대화형 AI는 스마트 안경에 음성 명령을 제공하고 소비자 애플리케이션용으로 인간의 음성과 유사한 합성 음성을 생성할 수 있습니다.

대화형 AI 애플리케이션을 위한 NVIDIA 솔루션

음성 AI

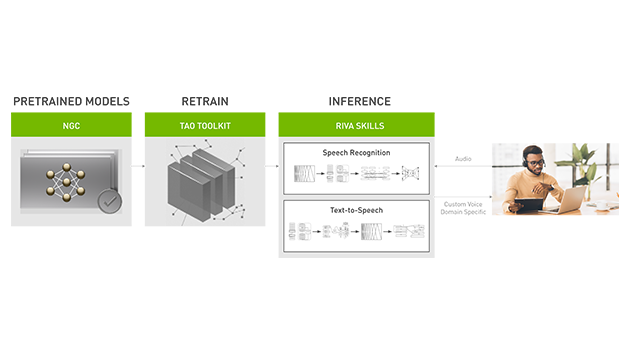

음성 AI 기술에는 자동 음성 인식(ASR)과 텍스트-음성 변환(TTS)이 있습니다. NVIDIA® Riva는 대화형 AI 애플리케이션에 통합할 수 있는 실시간 음성 AI 파이프라인을 개발하기 위한 GPU 가속 음성 AI SDK입니다.

Riva를 최대한 활용하려면 NVIDIA L4, A100, A10 또는 T4 Tensor 코어 GPU를 사용하세요. 음성 AI의 개념, 이점, 사용 사례, 과제에 대해 자세히 알아보려면 여기를 클릭하세요.

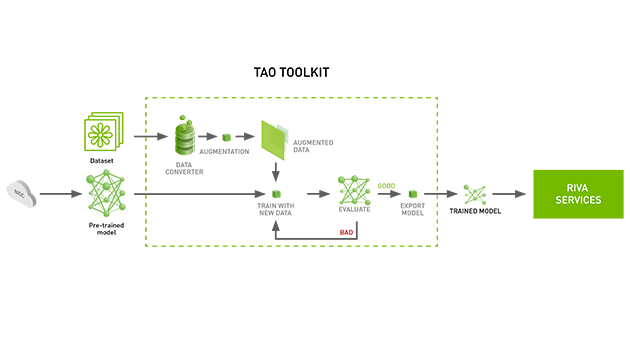

NVIDIA TAO Toolkit으로 더 스마트하게 학습

프로덕션급 NVIDIA 사전 학습 모델 및 NVIDIA TAO Toolkit을 사용하여 개발 속도를 10배까지 높일 수 있습니다.

NVIDIA Riva로 배포 간소화하기

클라우드, 데이터센터, 임베디드 디바이스, 엣지에서의 성능 극대화를 위해 최적화된 음성 AI 서비스를 배포하세요.

자연어 처리

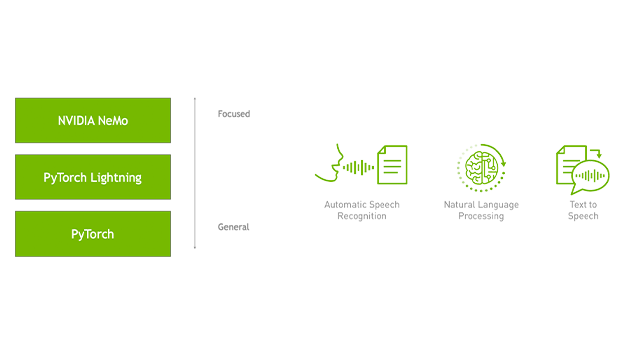

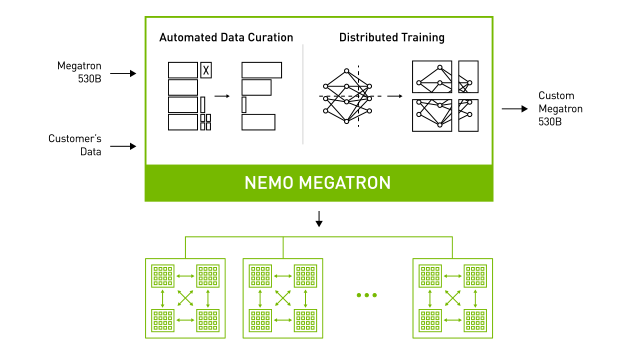

자연어 처리(NLP)에는 두 가지 유형이 있습니다. 매개변수가 적은 언어 모델과 매개변수를 수조 개까지도 갖는 대형 NLP 모델입니다. NVIDIA NeMo와 NeMo Megatron은 각각 소형 언어 모델과 대형 언어 모델을 트레이닝하기 위한 모델입니다.

프로덕션 단계에 고성능 추론을 위해 NeMo Megatron 모델을 NVIDIA Triton™ 추론 서버로 내보낼 수 있습니다. A100 GPU가 탑재된 NVIDIA DGX SuperPOD™에서 NeMo Megatron을 실행하여 성능을 극대화할 수 있습니다.

NVIDIA NeMo로 모델을 쉽게 개발

NVIDIA NeMo 오픈 소스 프레임워크를 사용하여 최첨단 음성 및 언어 모델을 구축, 트레이닝, 미세 조정합니다.

Nemo Megatron으로 대형 언어 모델을 트레이닝하세요

NeMo Megatron을 사용하여 트레이닝 데이터를 선별하고 매개변수가 1조 개에 달하는 대형 언어 모델을 쉽게 트레이닝하고 확장할 수 있습니다.

기업 및 개발자 라이브러리 가속화

- 에코시스템 파트너

- 개발자 라이브러리 가속화

최고의 음성, 영상 및 언어 워크플로우로 GPU 가속화하여 엔터프라이즈급 요구 사항을 충족하세요.

인기 있는 대화형 AI 라이브러리로 GPU 가속 최첨단 딥 러닝 모델을 구축하세요.

등록하고 NVIDIA의 최신 음성 AI 소식 받아보기