物理 AI 是什麼?

物理 AI 讓攝影機、機器人和自駕車等自主系統能感知、理解、推理,以及執行或協調物理世界複雜的動作。

物理 AI 為何重要?

在過去,自主機器無法感知四周的世界。然而,機器人內建生成式物理 AI 後,經過訓練,便能在現實世界與四周環境順暢互動,並且靈活應變。

若要打造物理 AI,團隊需要符合物理定律的強大模擬技術,為訓練自主機器提供安全受控的環境。這樣一來,不僅提高了機器人執行複雜任務的效率和準確度,也讓人機互動更自然,進而在現實世界應用提升易用性與功能性。

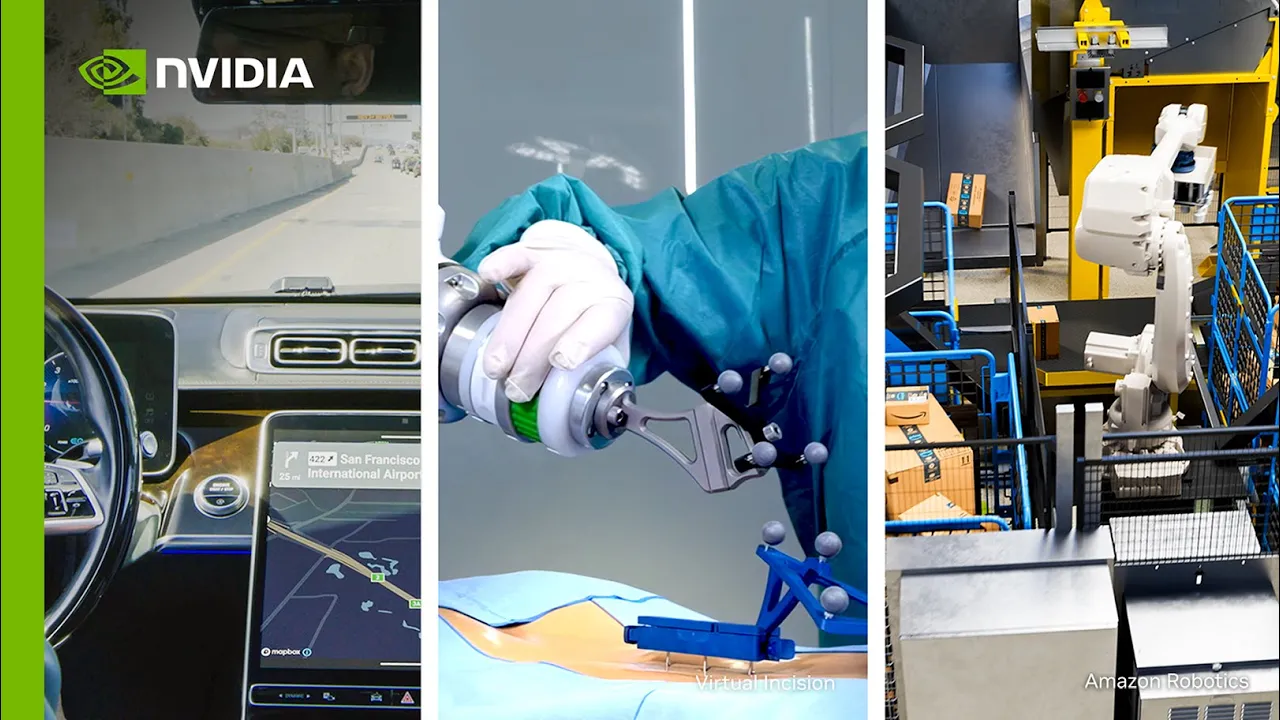

生成式物理 AI 正在開啟新功能,翻轉所有產業。舉例而言:

機器人:機器人採用物理 AI 後,在各種環境的作業能力都突飛猛進。

- 倉庫的自主移動機器人 (AMR) 利用車載感測器提供的直接回饋,可在複雜的環境穿梭自如,避開人類在內的障礙物。

- 機械臂可根據物品在輸送帶的擺放狀態,調整抓取強度與位置,展現出依物體類型所調整的精細與粗略動作能力。

- 手術機器人利用這項技術,能夠學習穿線與縫合等精密複雜的任務,突顯出生成式物理 AI 訓練機器人從事專門任務時的精準度與應變能力。

- 人形機器人作為通用型機器人,無論肩負何種任務,都需具備粗略與精細的動作能力,以及感知、理解、導航和與物理世界互動的能力。

自駕車 (AV):自駕車利用感測器感知並理解四周環境,因此能在開放式高速公路或城市景觀等各種環境,根據資訊做出決策。利用物理 AI 訓練自駕車,可讓車輛更準確偵測行人、回應交通或天氣狀況,並且自主變換車道,有效應對各種突發情境。

智慧空間:物理 AI 正在強化工廠和倉庫等大型室內外空間的功能性與安全性,因為這些空間的日常活動都有人流、車流和機器人往來穿梭。團隊利用固定式攝影機和先進的電腦視覺模型,可強化動態路線規劃,並且追蹤這些空間內的多個實體與活動,將營運效率最佳化。影片分析 AI 代理自動偵測異常情況並提供即時警示,進一步提升安全與效率。

物理 AI 如何運作?

GPT 和 Llama 這類生成式 AI 模型,經過多半從網路蒐集而來的大量文字與影像資料訓練。這類 AI 模型在生成人類語言與抽象概念方面的能力驚人,但是對於物理世界及其規則的理解力則有限。

物理 AI 以目前的生成式 AI 為基礎,增加了理解空間關係及現實 3D 世界物理行為的能力。它接收影像、影片、文字、語音或實際感測器資料等多模態輸入資料,然後轉化為自主機器可執行的深入解析或動作。

合成資料在開發物理 AI 方面的作用是什麼?

訓練物理 AI 模型時,需要現實世界空間關係與物理規則方面大量、多樣化且符合物理定律的資料。在真實世界環境蒐集這些資料的過程,可能繁瑣、容易出錯、危險且昂貴。模擬結合世界基礎模型 (WFM) 可大幅提升為訓練物理 AI 模型建立合成資料的能力。

資料生成的第一步是建立工廠這類空間的數位孿生。此外,運用 3D 高斯型重建技術,也可將真實世界的感測器資料直接匯入互動式模擬。感測器與機器人這類自主機器會加入這個虛擬空間。此外會執行模仿現實世界情境的模擬,而且感測器會擷取各種互動,例如運動與碰撞等剛體動力學,或者光線在環境的互動方式。接著便可利用 WFM 擴充、整理和標註生成的資料。

強化學習在物理 AI 的作用為何?

強化學習在模擬環境指導各種在現實世界執行的自主機器技能。這種學習方式讓自主機器透過成千上萬或甚至是數百萬次試錯,安全快速學習技能。

這種學習技術會在模擬中成功完成所需動作時給予物理 AI 模型獎勵,因此模型會持續調整精進。自主機器經過反覆強化學習,最終便能因時制宜,應對突發狀況,為了進入現實世界準備就緒。自主機器能夠與時俱進,培養出適用於真實世界所需的精細動作能力,例如俐落打包箱子、協助組裝車輛,或是在無人協助的情況下在環境穿梭自如。

如何開始使用物理 AI?

通用場景描述 (OpenUSD) 提供跨多個產業的通用資料標準,是物理 AI 的核心角色。這樣一來,便可實現互通性、即時協作、無縫整合,以及複雜 3D 環境的高效管理。

此外,OpenUSD 格式的模擬就緒資產嵌入了物理和語意屬性,因此資產馬上就能用於擬真 AI 互動和高擬真訓練。

利用物理 AI 打造新一代自主系統的過程,必須在多部專用電腦之間協調。

1. 訓練電腦:NVIDIA DGX

NVIDIA DGX™ 是完全整合的軟硬體 AI 平台,提供訓練物理 AI 基礎模型所需的強大運算能力。開發人員可運用實際或合成生成的資料,利用 TensorFlow、PyTorch、Cosmos Curator 或 NVIDIA TAO 等框架,搭配 NVIDIA NGC 提供的預先訓練電腦視覺模型,訓練或後期訓練基礎模型。DGX 系統能讓機器人透過密集的模型訓練,同時理解自然語言、辨識物體,並且規劃複雜的動作。

2. 模擬與合成資料生成電腦:在 NVIDIA RTX PRO 伺服器執行搭載 Cosmos 的NVIDIA Omniverse

建構虛擬 3D 環境

需要有擬真度高且符合物理定律的虛擬環境呈現真實環境,並且生成訓練物理 AI 所需的合成資料。NVIDIA Omniverse™ 是一系列用於開發工業數位孿生和物理 AI 模擬應用程式的函式庫和微服務。

運用 NVIDIA Omniverse NuRec 神經重建函式庫,將真實世界的感測器資料直接匯入模擬,即可建立這類數位孿生。NuRec 能讓開發人員重建場景、渲染互動式模擬,並且運用生成式 AI 提升重建品質,縮小現實世界與模擬之間的落差。

生成合成資料

物理 AI 的模擬環境除了準確反映真實世界的物理定律和行為,還必須符合千變萬化的日常互動與情境。使用 Omniverse Replicator 實現環境與物件領域隨機化。將隨機場景渲染為影像或影片,然後使用 NVIDIA Cosmos™ 模型擴充、整理及標註生成的資料,將單一場景擴充為成千上百個場景。

在模擬環境訓練及驗證機器人策略

模擬提供了訓練機器人各種技能的方法,例如操作物體或穿越空間。在 NVIDIA Isaac Lab 這個模組化機器人學習框架中,透過強化或模仿學習便可磨練這些技能。

模型及其軟體堆疊訓練完畢後,可利用 NVIDIA Isaac Sim™ 或開源 CARLA AV 模擬器等參考開源機器人模擬框架,在模擬環境中加以驗證。利用 NVIDIA Omniverse Blueprint 「Mega」可模擬及測試大批機器人機隊。

3. 執行階段電腦:NVIDIA Jetson Thor

最後,最佳化的堆疊與政策模型可部署於 NVIDIA Jetson™ 或 NVIDIA DRIVE AGX™,以內嵌方式在自主機器人、車輛或智慧空間運作。Jetson Thor 的設計精巧,運算能力可在毫秒內處理感測器資料、推理、規劃及執行動作,實現即時自主機器人操作。利用 Metropolis 影片搜尋與摘要 (VSS) AI Blueprint 打造影像分析 AI 代理,在邊緣分析及最佳化工廠效能的監督,提升工作人員安全。在資料中心運用 NVIDIA RTX PRO 伺服器擴大推論工作負載。