概要

対話型 AI とは?

対話型 AI は、AI バーチャル アシスタント、デジタル ヒューマン、チャットボットを支え、パーソナライズされた自然な人間と機械の会話を実現する道を拓いています。 しかし、リアルタイムのインタラクションには、高い精度と速度が求められます。 Nemotron Speech オープン モデルと NVIDIA Riva ライブラリにより、開発者は応答性の高い音声および翻訳機能を構築し、エージェント型 AI アプリケーションに自然な音声インターフェイスを追加できます。

利点

対話型 AI の利点を見る

窓口の効率化

顧客との会話をリアルタイムで書き起こし、分析し、提案することで顧客の問いをすばやく解決し、コンタクト センターの窓口を支援します。

デジタルおよびグローバル アクセシビリティ

聴覚に問題を抱える方がオーディオ コンテンツを利用できるようにし、発話が困難な方が複数の言語で自己表現できるようにします。

24 時間年中無休のサービス

チャットボットと AI 仮想アシスタントを利用することで、窓口の通常営業時間以外でも顧客の問いに答え、価値ある情報を提供することができます。

人を惹きつける体験

ライブ キャプション、表現力豊かな合成音声、顧客の嗜好の理解などの機能で、人を引きつける体験を提供します。

ソフトウェア

NVIDIA の対話型 AI ソフトウェアを見る

ユース ケース

対話型 AI の使用方法

NVIDIA AI は産業の各種ユース ケースに対応しており、厳選されたサンプルを備えているため、対話型 AI 開発をすぐにでも始められます。

-

医療エージェント

-

AI バーチャル アシスタント

-

エージェント アシスト

-

AI 翻訳

-

フィジカル AI

医療エージェント

医療分野では、高精度かつ文脈を理解する AI により、患者とのやりとりが再構築されています。 Nemotron モデルを活用することで、組織は臨床効率と患者体験のギャップを埋めることができます。

アンビエント音声エージェントは、文脈と意図を理解し、構造化された臨床ドキュメントを自律的に生成します。音声エージェントは、予約や問診など大量の患者対応を担当し、柔軟な推論によって共感的でパーソナライズされたやり取りを実現します。

エージェント アシスト

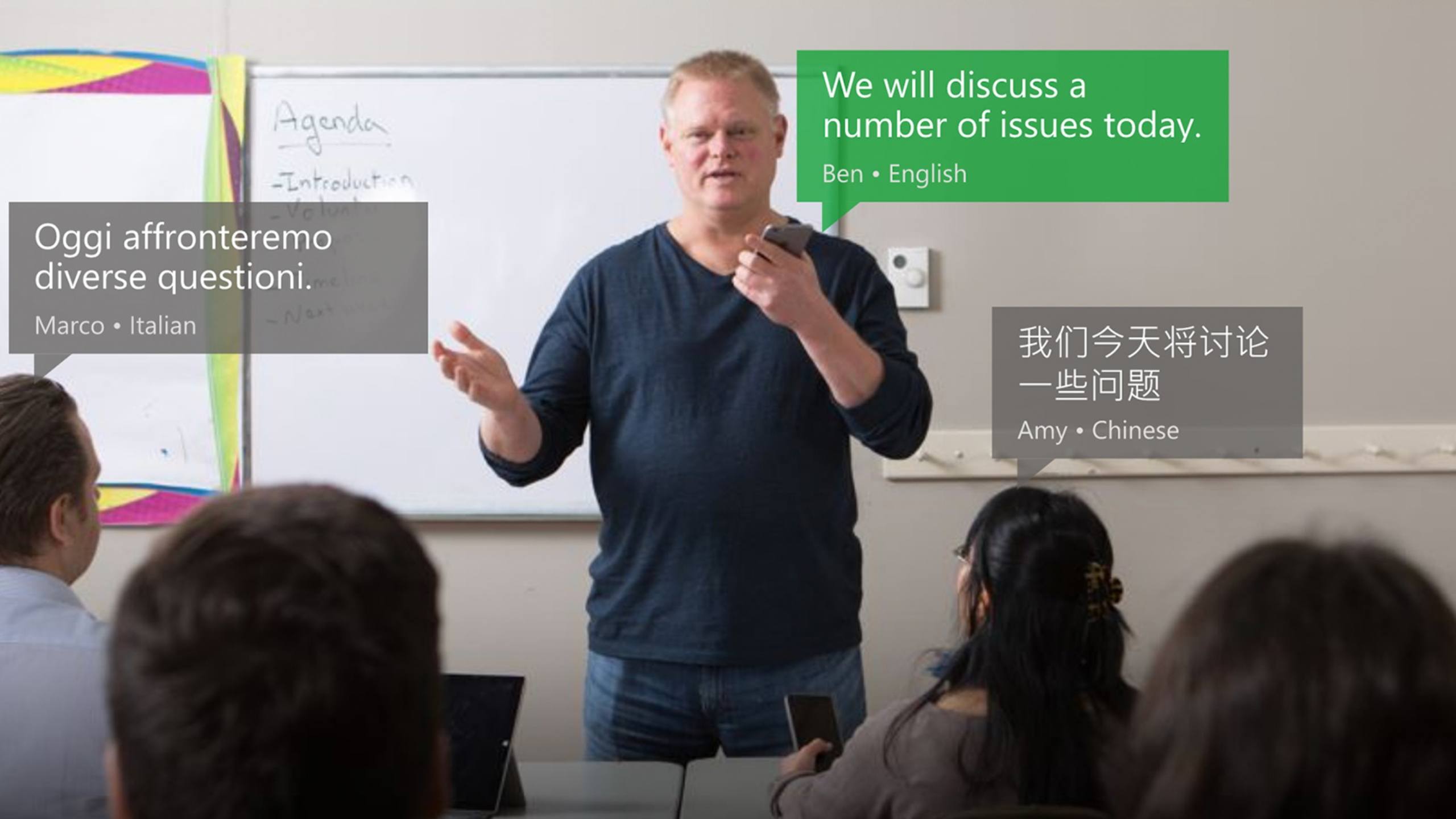

AI 翻訳

グローバル経済では、企業は毎日、無数のオンライン会議を開催し、さまざまな言語背景を持つ顧客にサービスを提供しています。企業はリアルタイムの文字起こしと翻訳を活用することで、正確なライブ字幕を生成し、世界中のアクセントや業界特有の用語にも対応できます。Nemotron モデルを要約やインサイトの生成に活用することで、効果的なコミュニケーションと円滑なグローバル インタラクションを実現できます。

フィジカル AI

サービス ロボットや音声指示で動く機械は、世界中の病院、製造現場、空港、小売店などで広く利用されるようになっています。 飲食店や製造現場で日常的に繰り返される作業を手伝い、店内で品物を探すお客様を手助けし、医師や看護師による患者ケアをサポートすることで、現場スタッフを支援します。 Nemotron 音声モデルをエッジに直接デプロイすることで、これらのロボットはほぼ瞬時の音声インタラクションを提供し、接続が制限された環境でも高い運用信頼性を維持します。