Videoanalyse-KI-Agenten

Nutzen Sie unsere Sammlung an Referenz-Workflows mit Vision-Sprachmodellen (Vision Language Models) für vielfältige, interaktive visuelle Wahrnehmungsfunktionen in unterschiedlichsten Branchen.

Workloads

Computer Vision/Videoanalyse

Branchen

Einzelhandel/Konsumgüter

Fertigung

Smart Citys/Räume

Gesundheitswesen und Biowissenschaftens

Geschäftsziel

Return on Investment (Rentabilität) Innovation

Overview

Bringen Sie eine neue Welle von Anwendungen ins Rollen

Herkömmliche Videoanalysen und ihre Entwicklungs-Workflows basieren in der Regel auf einer begrenzten Gruppe von Modellen mit festen Funktionen, die darauf ausgerichtet sind, vordefinierte Objekte zu erkennen und zu identifizieren. Mit generativen KI- und Grundlagenmodellen können Sie jetzt Anwendungen mit weniger Modellen erstellen. Diese weisen eine unglaublich komplexe und breite Wahrnehmung und ein umfassendes kontextuelles Verständnis auf. Diese neue Generation von Vision Language Models (VLMs), wie NVIDIA Cosmos™ Reason, ermöglicht intelligente, leistungsstarke KI-Agenten für die Videoanalyse.

Was ist ein Visual AI Agent?

Ein KI-Agent für die Videoanalyse kann sehen, logisch denken und handeln, indem er Bild- und Sprachmodalitäten kombiniert, um eine Vielzahl von Fragen oder Aufforderungen in natürlicher Sprache zu verstehen, die auf einen aufgezeichneten oder Live-Videostream angewendet werden. Dieses tiefere Verständnis von Videoinhalten ermöglicht genauere und aussagekräftige Interpretationen, verbessert die Funktionalität von Videoanalyseanwendungen und die Analyse von realen Szenarien. Diese Agenten versprechen völlig neue Erkenntnisse und Möglichkeiten für die Automatisierung.

Optimieren Sie sämtliche industrielle Vorgänge

Hochgradig wahrnehmende, genaue und interaktive visuelle KI-Agenten werden in unseren Fabriken, Lagern, Einzelhandelsgeschäften, Flughäfen, Verkehrskreuzungen und in anderen Bereichen zum Einsatz kommen. Dies wird einen enormen Einfluss auf Einsatzteams haben, die auf Basis umfassenderer Erkenntnisse aus natürlichen Interaktionen ihre Entscheidungen verbessern können. In natürlicher Sprache kommunizieren dann die Manager und Einsatzteams mit diesen Agenten, welche alle auf generativer KI und großen Vision-Sprachmodellen mit NVIDIA NIM™-Microservices basieren.

Quick-Links

Technische Umsetzung

Mit NVIDIA Cosmos Reason NIM entwickeln

Das Gehirn in jedem KI-Agenten für die Videoanalyse ist ein VLM, das sehen und schlussfolgern kann. Zwei gängige VLMs sind Cosmos Embed und Cosmos Reason. Beide können verwendet werden, um aktuelle Computer-Vision-Anwendungen mit umfangreichen Metadaten und Inhaltszusammenfassungen zu ergänzen.

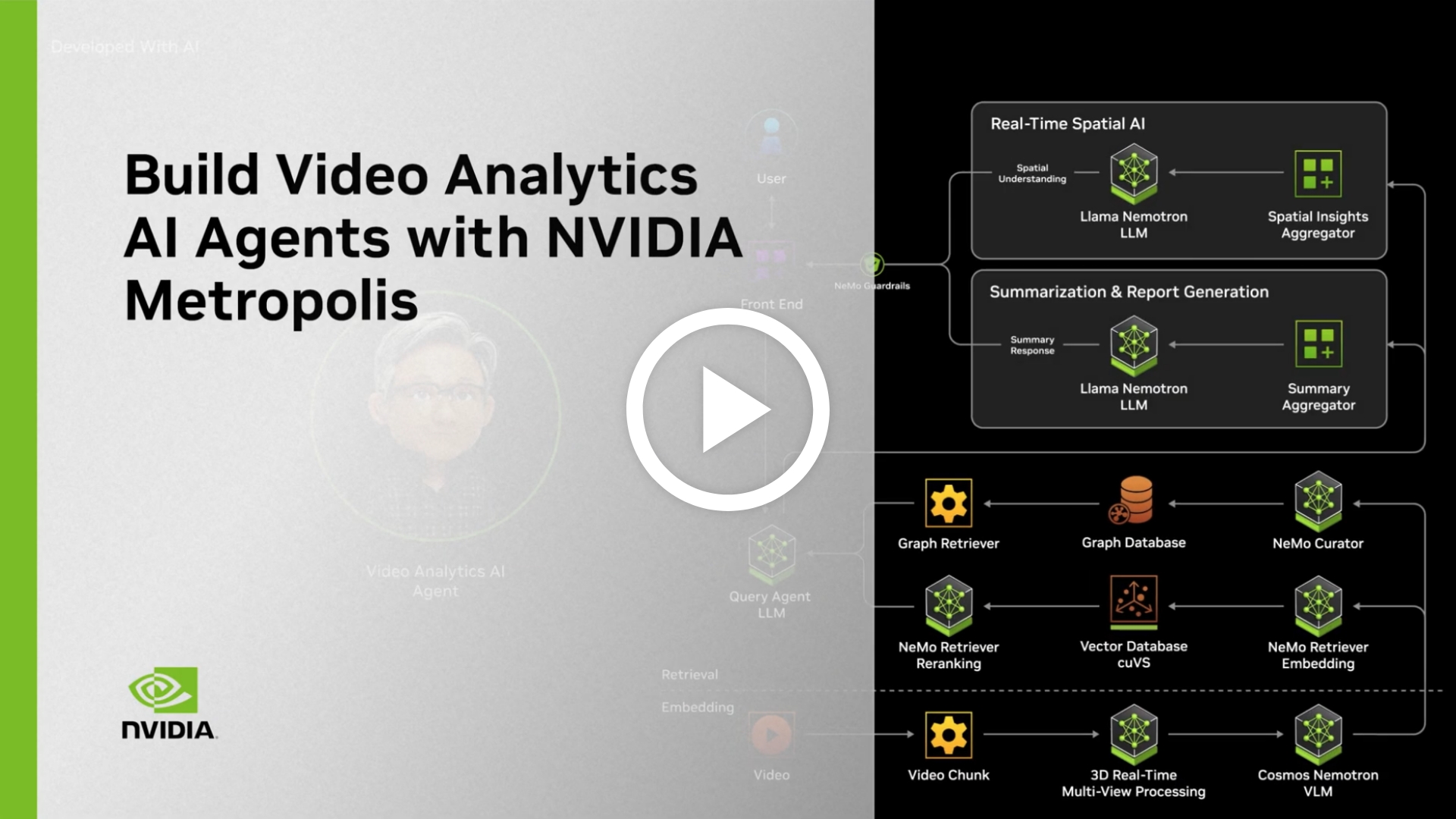

NVIDIA NIM besteht aus einer Reihe von beschleunigten Inferenz-Microservices, die für NVIDIA-GPUs optimiert sind und branchenübliche APIs, fachspezifischen Code, optimierte Inferenz-Engines und eine Unternehmens-Laufzeitumgebung umfassen. Es bietet eine Kombination aus VLMs, großen Sprachmodellen (LLMs) und Retrieval-Augmented Generation (RAG) für die Entwicklung Ihres KI-Agenten für die Videoanalyse, der Live- oder archivierte Bilder oder Videos verarbeiten kann, um mithilfe natürlicher Sprache umsetzbare Erkenntnisse zu extrahieren. Wir haben einen Referenz-Workflow eines KI-Agenten für die Videoanalyse erstellt, den Sie ausprobieren können, um Ihren Entwicklungsprozess zu beschleunigen.

Quick-Links

Erstellen Sie KI-Agenten mit NVIDIA VSS Blueprint

Der NVIDIA Blueprint für Videosuche und Zusammenfassung (VSS) erleichtert die Erstellung und Anpassung von KI-Agenten für die Videoanalyse mithilfe von generativer KI, VLMs, LLMs, RAG und NVIDIA NIM. Die KI-Agenten für die Videoanalyse erhalten Aufgaben in natürlicher Sprache und können große Mengen von Videodaten verarbeiten, um wichtige Erkenntnisse zu analysieren, interpretieren und gewinnen. Diese helfen einer Reihe von Branchen dabei, Prozesse zu optimieren, die Sicherheit zu verbessern und Kosten zu senken.

VSS bietet modularisierte Komponenten, die eine hohe Flexibilität ermöglichen, beschleunigte Microservices, die Echtzeit-Videointelligenz unterstützen, agentische Suche über verschiedene Einbettungen hinweg sowie umfassende Funktionen zur Berichterstellung.

VSS ermöglicht außerdem die nahtlose Integration von generativer KI in bestehende Computer-Vision-Pipelines und verbessert so die Inspektion, Suche und Analyse mit multimodalem Verständnis und Zero-Shot-Reasoning. VSS lässt sich problemlos vom Edge bis zur Cloud auf Plattformen wie NVIDIA RTX 4500, NVIDIA RTX PRO™ 6000, NVIDIA DGX Spark™ und NVIDIA® Jetson Thor™ bereitstellen.

Quick-Links

FAQs

NIM beinhaltet eine Reihe von einfach zu bedienenden Mikroservices, die für die sichere und zuverlässige Bereitstellung von hochleistungsfähigen KI-Modellinferenzen in der Cloud, im Rechenzentrum und auf Workstations entwickelt wurden. Es unterstützt eine Vielzahl von KI-Modellen, darunter Modelle der Open-Source-Community und NVIDIA KI-Foundation-Modelle, um eine nahtlose, skalierbare KI-Inferenz – vor Ort oder in der Cloud – mit branchenüblichen APIs zu gewährleisten. Alle NIM-Microservices und zugehörige Vorschau-APIs finden Sie unter build.nvidia.com.

Besuchen Sie build.nvidia.com, um ein Konto zu erstellen und die verfügbaren NIM-Microservices zu erkunden. Sie können NVIDIA Cosmos Reason VLM NIM erkunden.

Testen Sie den NVIDIA AI Blueprint für Videosuche und Zusammenfassungen kostenlos.

Alle Benutzer können kostenlos mit den Vorschau-APIs auf build.nvidia.com beginnen. Jedes neue Konto kann bis zu 5.000 Credits erhalten, um die APIs auszuprobieren. Um die Entwicklung fortzusetzen, nachdem die Credits aufgebraucht sind, können Sie die herunterladbaren NIM-Microservices lokal auf Ihrer Hardware oder auf einer Cloud-Instanz bereitstellen. Entwickler können auch über das NVIDIA-Entwicklerprogramm auf NIM zugreifen. Einzelheiten finden Sie in diesen FAQ.

NVIDIA NIM kann von Entwicklern kostenlos ausprobiert werden. Um in den Produktivbetrieb überzugehen, benötigen herunterladbare NIM-Microservices eine NVIDIA-AI-Enterprise-Lizenz. Mehr dazu erfahren Sie auf dieser Seite.

Das NIM-Entwicklerforum ist der beste Ort, um Fragen zu stellen und mit unserer Entwickler-Community zu interagieren. Hier können Sie auf die Foren zugreifen.

Erstellen von visuellen AI-Agenten

Erkunden Sie den Referenz-Workflow, der von mehreren Visual Language Models unterstützt wird, um Ihren visuellen AI-Agenten einfach zu erstellen.

Entwickler in Aktion

Stellen Sie KI-Agenten vom Edge bis zur Cloud bereit.

Nutzen Sie die Leistung des VSS-Blueprints, um KI-Agenten nahtlos vom Edge bis zur Cloud bereitzustellen,