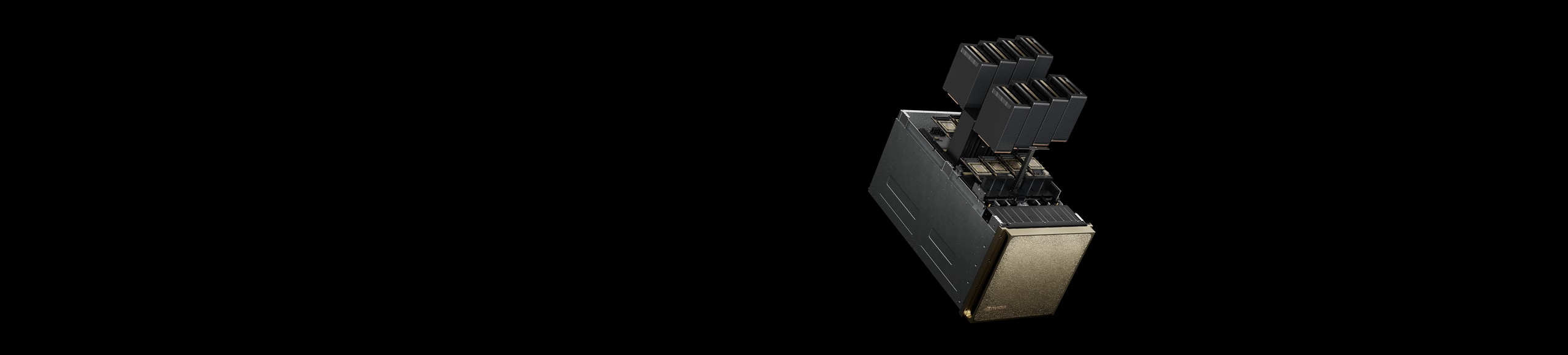

NVIDIA DGX B200

Le basi per la tua fabbrica IA.

Prestazioni rivoluzionarie basate sull'innovazione evolutiva

NVIDIA DGX™ B200 è una piattaforma IA unificata per le pipeline dallo sviluppo alla distribuzione dedicata a società di qualsiasi dimensione in tutte le fasi del loro percorso verso l'IA. Dotata di otto GPU NVIDIA Blackwell interconnesse con NVIDIA® NVLink™ di quinta generazione, NVIDIA DGX B200 offre prestazioni di addestramento 3 volte superiori e 15 volte superiori rispetto ai sistemi della generazione precedente. Sfruttando l'architettura NVIDIA Blackwell, DGX B200 è in grado di gestire diversi carichi di lavoro, tra cui modelli linguistici di grandi dimensioni, sistemi recommender e chatbot, rendendola ideale per le aziende che desiderano accelerare la loro trasformazione IA.

Vantaggi

Una fabbrica IA unificata

Prestazioni

Prestazioni di nuova generazione basate su NVIDIA DGX B200

Inferenza in tempo reale di modelli linguistici di grandi dimensioni

Prestazioni previste soggette a modifica. Latenza da token a token (TTL) = 50 ms in tempo reale, latenza del primo token (FTL) = 5 s, lunghezza della sequenza di ingresso = 32.768, lunghezza della sequenza di output = 1.028, 8x GPU NVIDIA DGX H100 con raffreddamento ad aria rispetto a 1x NVIDIA DGX B200 con raffreddamento ad aria a otto vie, per confronto delle prestazioni della GPU.

Prestazioni di addestramento IA potenziate

Prestazioni previste soggette a modifica. Scala 32.768 GPU, cluster raffreddato ad aria 4.096x a otto vie: rete IB 400G, cluster raffreddato ad aria 4.096x a otto vie: rete IB 400G, cluster raffreddato ad aria 4.096x a 8 vie: rete IB 400G.

Specifiche

Specifiche di NVIDIA DGX B200

| GPU | 8 GPU NVIDIA Blackwell |

| Memoria della GPU | 1,440 GB di memoria GPU totale |

| Prestazioni | 76 petaFLOPS di training a FP8 e 144 petaFLOPS di inferenza |

| Consumo energetico | ~14,3 kW max |

| CPU | 2 Processori Intel® Xeon® Platinum 8570 112 Core totali, 2,1 GHz (base), 4 GHz (boost massimo) |

| Memoria di sistema | Fino a 4 TB |

| Networking | 4 porte OSFP per 8 NVIDIA ConnectX-7 VPI a porta singola

|

| Management Network | NIC integrata da 10 Gb/s con RJ45 NIC Ethernet 100 Gb/s dual-port Controller di gestione della scheda madre in host (BMC) con RJ45 |

| Storage | SO: 2 NVMe M.2 da 1,9 TB Memoria interna: 8 NVMe U.2 da 3,84 TB |

| Software | NVIDIA AI Enterprise: software IA ottimizzato NVIDIA Mission Control - Operazioni IA relative a data center e orchestrazione con tecnologia NVIDIA Run:ai NVIDIA DGX OS/Ubuntu - Sistema operativo |

| Rack Units (RU) | 10 RU |

| System Dimensions | Altezza: 444 mm Larghezza: 482,2 mm Lunghezza: 897,1 mm |

| Operating Temperature | 5-30 °C (41-86 °F) |

| Enterprise Support | Tre anni di supporto Enterprise Business-Standard per hardware e software Accesso 24/7 al portale del supporto Enterprise Supporto con operatore in tempo reale durante l'orario di lavoro locale |

Risorse

Fornire le fabbriche IA in ogni azienda

NVIDIA DGX SuperPOD

NVIDIA DGX SuperPOD è una soluzione di infrastruttura per data center IA chiavi in mano che offre prestazioni senza compromessi per ogni utente e carico di lavoro. Configurabile con qualsiasi sistema DGX NVIDIA , DGX SuperPOD offre un'infrastruttura accelerata di prim'ordine con prestazioni scalabili per i carichi di lavoro di addestramento e inferenza IA più esigenti, con risultati comprovati nel settore, consentendo all'IT di offrire prestazioni senza compromessi.

NVIDIA presenta Mission Control

NVIDIA Mission Control semplifica le operazioni delle fabbriche IA, dai carichi di lavoro all'infrastruttura, con competenze di prim'ordine in formato software. Alimenta i data center NVIDIA Blackwell, portando agilità istantanea per l'inferenza e l'addestramento, fornendo al contempo intelligenza a stack completo per la resilienza dell'infrastruttura. Ogni azienda può eseguire l'IA con efficienza iperscalabile, semplificando e accelerando la sperimentazione IA.

Incrementa il valore della piattaforma DGX NVIDIA

I servizi NVIDIA Enterprise offrono supporto, formazione e servizi professionali alla tua infrastruttura DGX NVIDIA. Con gli esperti NVIDIA disponibili in ogni fase del tuo percorso nell'IA, i servizi Enterprise possono aiutarti ad attivare i progetti in modo rapido ed efficace

Ricevi un'offerta di formazione esclusiva come cliente NVIDIA DGX

Scopri come realizzare più velocemente innovazioni all'avanguardia con l'IA con questa formazione tecnica speciale offerta espressamente ai clienti NVIDIA DGX dagli esperti di IA del Deep Learning Institute (DLI) di NVIDIA.

FAQ su NVIDIA Blackwell

I sistemi basati su NVIDIA Blackwell offrono inferenza IA a un costo di 0,02 dollari per milione di token su GPT-OSS-120B utilizzando NVIDIA TensorRT™-LLM, come verificato dai benchmark SemiAnalysis InferenceX (Q1 2026). 0,02 dollari per milione di token su GPT-OSS-120B segna un miglioramento di 5 volte rispetto ai costi del giorno di lancio di Blackwell, grazie alla continua ottimizzazione del software.

La metrica più importante per il TCO dell'inferenza IA è il costo per token, ovvero il rapporto prezzo-prestazioni effettivamente offerto. Secondo i benchmark SemiAnalysis InferenceX dell'aprile 2026, i sistemi basati su NVIDIA Blackwell offrono inferenza a circa 0,02 dollari per milione di token a 55 TPS/utente per GPT-OSS-120B utilizzando TensorRT-LLM, circa 4,5 volte più economici rispetto ai sistemi basati su NVIDIA Hopper a 0,09 dollari per milione di token con vLLM.

Inizia