NVIDIA NVLink 與 NVLink 交換器

採用高頻寬 GPU 之間通訊的垂直擴充網狀架構,適用於 AI 訓練與推論等要求嚴苛的機架級 GPU 加速工作負載。

加速垂直擴充互連的需求

整個伺服器機架必須有順暢的高傳輸量 GPU 對 GPU 通訊,最新的 AI 模型才能達到最高效能。第六代 NVIDIA NVLink™ 與 NVLink 交換器採用低延遲的超大網路頻寬,具備全互連能力,是專為加速訓練與推論而設計,推理與代理 AI 工作負載速度更快。

利用 NVIDIA NVLink 將系統傳輸量與正常運作時間最大化

第六代 NVLink 為 NVIDIA Rubin 平台上的每顆 GPU 提供高達每秒 3.6 TB 的頻寬,效能較前一代提升 2 倍,並比 PCIe Gen6 高出 14 倍。NVIDIA Vera Rubin NVL72 這類機架級架構,可在全互連拓撲下連接 72 顆 GPU,總頻寬為 260 TB/s,為訓練與推論頂尖混合專家模型架構所需的全互連通訊提供超大頻寬。NVLink 6 交換器亦導入全新的管理和韌性設計功能,可將系統正常運作時間最大化,包括控制平面的韌性、支援機架部分部署運行,以及交換器托盤 (switch tray) 的熱插拔功能。

NVLink 大規模效能

NVIDIA Rubin 的第六代 NVIDIA NVLink,GPU 對 GPU 通訊頻寬是前一代的 2 倍,利用最新 AI 模型架構加速訓練與推論。

使用 NVLink Communications 提高邏輯推理輸送量

用 NVIDIA NVLink 和 NVLink 交換器完整連接多個 GPU

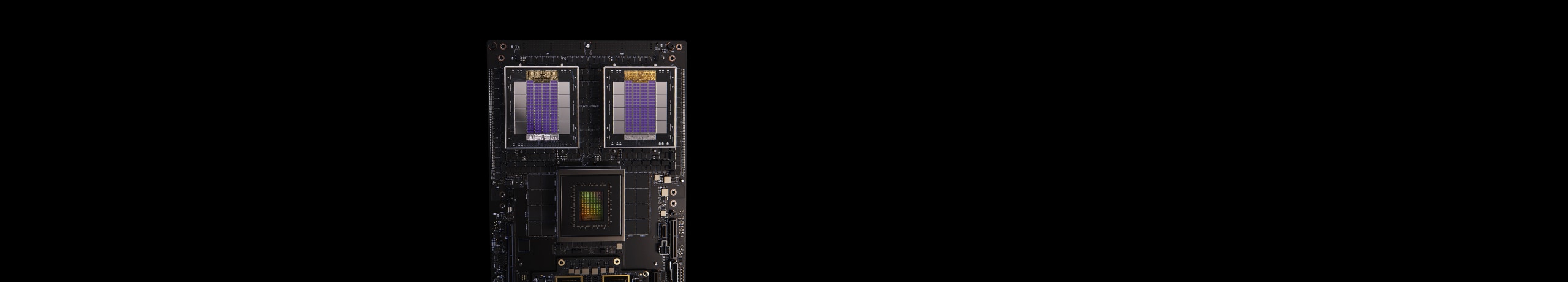

NVLink 是 3.6 TB/s 的雙向直接 GPU 互連技術,可擴充伺服器內多顆 GPU 的輸入和輸出 (IO) 規模。NVIDIA NVLink 交換器晶片連接多個 NVLink,在整個機架內以完整的 NVLink 速度提供 GPU 全互連通訊。

為實現高速集體作業,每款 NVLink 交換器皆配備 NVIDIA Scalable Hierarchical Aggregation and Reduction Protocol (SHARP)™ 引擎,實現網路歸約 (in-network reduction) 並加速多播 (multicast) 通訊。

利用 NVLink 交換器系統加速兆級參數模型的測試時邏輯推理

NVLink 交換器可讓 NVLink 連線跨節點延伸,並建立流暢且高頻寬的多節點 GPU 叢集,有效將 GPU 擴充至資料中心適用大小。NVIDIA NVLink 交換器在單一 NVIDIA Vera Rubin NVL72 中支援 260 TB/s 的 GPU 頻寬,實現大型模型平行運算。採用 NVLink 的多伺服器叢集可在提升運算能力的同時,擴充 GPU 之間的通訊,因此 NVIDIA Vera Rubin NVL72 可支援的 GPU 數量為單一八 GPU 系統的 9 倍。

NVIDIA NVLink Fusion

NVIDIA NVLink™ Fusion 提供的 AI 垂直擴充與橫向擴充效能領先業界,結合 NVIDIA 技術及半自訂 ASIC 或 CPU,讓超大規模企業能夠採用 NVIDIA NVLink 技術和機架級架構,打造 ASIC 混合型 AI 基礎架構。

從企業級擴充至百萬兆級

完全連接,效能絕倫

Vera Rubin NVL72 採用 NVLink 交換器晶片,可讓 72 顆 GPU 在非阻塞運算網狀架構完全互連。NVLink 交換器以驚人的 3.6 TB/s 速度互連每一對 GPU。支援完整的 all-to-all 通訊。Vera Rubin NVL72 中的 72 顆 GPU 可作為單一高效能加速器,AI 運算能力高達 3.6 exaFLOPS。

最強大的人工智慧和高效能運算平台

完整的 NVIDIA 資料中心解決方案整合了硬體、網路、軟體、函式庫以及 NVIDIA AI Enterprise 軟體套件與 NVIDIA NGC™ 目錄上的最佳化 AI 模型和應用程式,而 NVLink 與 NVLink 交換器則是解決方案的重要基石。 此功能最強大的端對端人工智慧和高效能運算平台,可以讓研究人員提供真實世界結果,並將解決方案部署到生產環境中,為各種規模的作業提供前所未有的加速效能。

規格

-

NVLink

-

NVLink Switch

| 第四代 | 第五代 | 第六代 | |

|---|---|---|---|

| 每個 GPU 的 NVLink 頻寬 | 每秒 900 GB | 每秒 1,800 GB | 每秒 3,600 GB |

| 每 GPU 連結數量上限 | 18 | 18 | 36 |

| 支援的 NVIDIA 架構 | NVIDIA Hopper™ 架構 | NVIDIA Blackwell 架構 | NVIDIA Rubin 平台 |

| NVLink 4 交換器 | NVLink 5 交換器 | NVLink 6 交換器 | |

|---|---|---|---|

| NVLink 網域中直接互連的 GPU 數量 | 高達 8 個 | 8 |72 | 8 |72 |

| NVSwitch GPU 至 GPU 頻寬 | 每秒 900 GB | 每秒 1,800 GB | 每秒 3,600 GB |

| 總頻寬調配 | 每秒 7.2 TB | 每秒 130 TB (NVL72) | 每秒 260 TB (NVL72) |

| 支援的 NVIDIA 架構 | NVIDIA Hopper™ 架構 | NVIDIA Blackwell 架構 | NVIDIA Rubin 平台 |

初步規格;可能隨時變更。

深入瞭解 NVIDIA Rubin 平台。