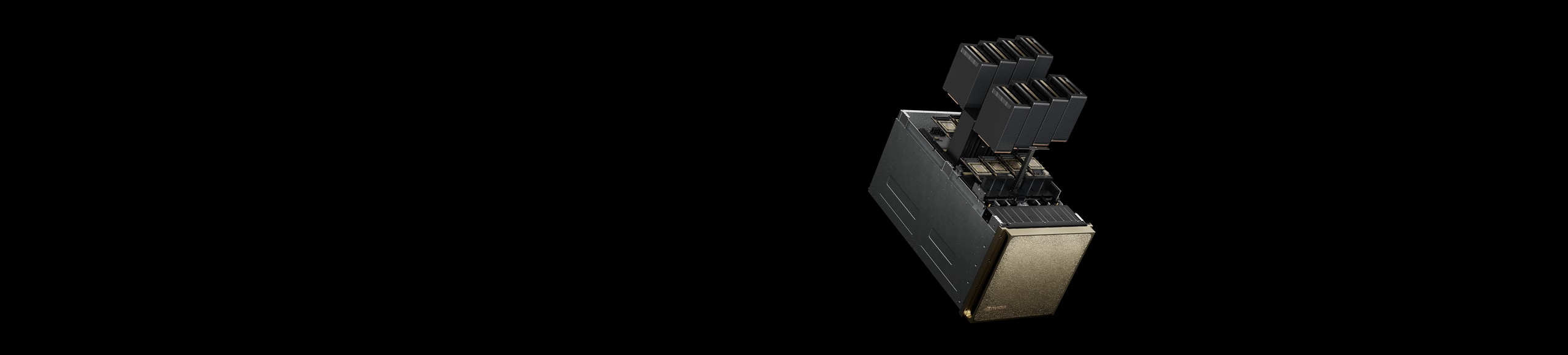

NVIDIA DGX B200

Los cimientos de su fábrica de IA.

Rendimiento revolucionario respaldado por innovación evolutiva

NVIDIA DGX™ B200 es una plataforma de IA unificada para procesos de desarrollo a implementación para empresas de cualquier tamaño en cualquier etapa de su viaje de IA. Equipada con ocho GPU NVIDIA Blackwell interconectadas con NVIDIA® NVLink™ de 5.ª generación, NVIDIA DGX B200 ofrece 3 veces el rendimiento de entrenamiento y 15 veces el rendimiento de inferencia que los sistemas de la generación anterior. Al aprovechar la arquitectura NVIDIA Blackwell, DGX B200 puede manejar diversas cargas de trabajo, incluidos modelos lingüísticos de gran tamaño, sistemas de recomendación y chatbots, lo que la convierte en ideal para empresas que buscan acelerar su transformación de IA.

Ventajas

Una fábrica de IA unificada

Rendimiento

Rendimiento de próxima generación con tecnología de NVIDIA DGX B200

Inferencia de modelos lingüísticos de gran tamaño en tiempo real

El rendimiento proyectado está sujeto a cambios. Latencia de token a token (TTL) = 50 ms en tiempo real, primera latencia de token (FTL) = 5 s, longitud de secuencia de entrada = 32 768, longitud de secuencia de salida = 1 028, 8 GPU NVIDIA DGX H100 de ocho direcciones refrigeradas por aire frente a 1 NVIDIA DGX B200 de ocho direcciones, por comparación de rendimiento de GPU.

Rendimiento sobrealimentado de entrenamiento de IA

El rendimiento proyectado está sujeto a cambios. Escala de 32 768 GPU, 4 096 clústeres refrigerados por aire NVIDIA DGX H100 de ocho direcciones: red 400G IB, 4 096 clústeres refrigerados por aire NVIDIA DGX B200 de ocho direcciones: red 400G IB.

Especificaciones

Especificaciones de NVIDIA DGX B200

| Tarjeta gráfica (GPU) | 8 GPU NVIDIA Blackwell |

| Memoria de GPU | Un total de 1440 GB de memoria de GPU |

| Rendimiento | 72 petaFLOPS de entrenamiento y 144 petaFLOPS de inferencia |

| Consumo de energía | ~14,3 kW máx. |

| CPU | 2 Procesadores Intel® Xeon® Platinum 8570 112 núcleos en total, 2,1 GHz (base), 4 GHz (impulso máximo) |

| Memoria del sistema | Hasta 4 TB |

| Redes | 4 puertos OSFP para 8 VPI NVIDIA ConnectX-7 de un solo puerto

|

| Redes | NIC integrada de 10 Gb/s con RJ45 NIC ethernet de doble puerto de 100 Gb/s Controlador de gestión de placa base (BMC) de host con RJ45 |

| Almacenamiento | SO: 2 NVMe M.2 de 1,9 TB Almacenamiento interno: 8 NVMe U.2 de 3,84 TB |

| Software | NVIDIA AI Enterprise: software de IA optimizado NVIDIA Mission Control: operaciones y orquestación de centros de datos de IA con la tecnología NVIDIA Run:ai NVIDIA DGX OS/Ubuntu: sistema operativo |

| Rack Units (RU) | 10 RU |

| System Dimensions | Altura: 444 mm (17,5 pulgadas) Ancho: 482,2 mm (19,0 pulgadas) Longitud: 897,1 mm (35,3 pulgadas) |

| Operating Temperature | 5–30 °C (41–86 °F) |

| Enterprise Support | Soporte técnico empresarial durante tres años para hardware y software Portal de soporte para empresas ininterrumpido Soporte de un agente en directo durante el horario comercial local |

Recursos

Proporcionar fábricas de IA a todas las empresas

NVIDIA DGX SuperPOD

NVIDIA DGX SuperPOD es una solución de infraestructura de centro de datos de IA llave en mano que ofrece un rendimiento sin concesiones para cada usuario y carga de trabajo. DGX SuperPOD, que se puede configurar con cualquier sistema NVIDIA DGX, proporciona una infraestructura acelerada de primer nivel con rendimiento escalable para las cargas de trabajo de entrenamiento e inferencia de IA más exigentes, con resultados probados en el sector, lo que le permite al departamento de TI ofrecer rendimiento sin concesiones.

Presentamos NVIDIA Mission Control

NVIDIA Mission Control agiliza las operaciones de fábrica de IA, desde las cargas de trabajo hasta la infraestructura, con experiencia de clase mundial entregada como software. Se trata del motor de los centros de datos NVIDIA Blackwell, lo que aporta agilidad instantánea para la inferencia y el entrenamiento, al tiempo que proporciona inteligencia de pila completa para la resiliencia de la infraestructura. Cualquier empresa podrá ejecutar IA con eficiencia a hiperescala, lo que simplifica y acelera la experimentación de IA.

Maximice el valor de la plataforma NVIDIA DGX

Los servicios empresariales de NVIDIA ofrecen soporte, formación y servicios profesionales para su infraestructura NVIDIA DGX. Al disponer de los expertos de NVIDIA en cada paso de su viaje de IA, los servicios empresariales pueden ayudarle a poner en marcha sus proyectos de forma rápida y exitosa

Reciba una oferta de formación exclusiva como cliente de NVIDIA DGX

Descubra cómo lograr avances de vanguardia con IA más rápido con esta formación técnica especial ofrecida expresamente a los clientes de NVIDIA DGX por los expertos en IA del Deep Learning Institute (DLI) de NVIDIA.

Preguntas frecuentes de NVIDIA Blackwell

Los sistemas con tecnología de NVIDIA Blackwell proporcionan inferencia de IA a 0,02 USD por millón de tókenes en GPT-OSS-120B utilizando NVIDIA TensorRT™-LLM, tal y como verificaron las pruebas de referencia de SemiAnalysis InferenceX (primer trimestre de 2026). 0,02 USD por millón de tókenes en GPT-OSS-120B representa una mejora 5 veces superior a la de Blackwell el mismo día del lanzamiento, gracias a la optimización continua del software.

El parámetro más importante para el coste total de propiedad de inferencia de IA es el coste por token o la relación precio-rendimiento que se obtiene realmente. Según las pruebas de referencia de SemiAnalysis InferenceX de abril de 2026, los sistemas con tecnología de NVIDIA Blackwell proporcionan inferencia a un precio de aproximadamente 0,02 USD por millón de tókenes a 55 TPS/usuario para GPT-OSS-120B utilizando TensorRT-LLM, lo cual es aproximadamente 4,5 veces más barato que los sistemas con tecnología de NVIDIA Hopper a un precio de 0,09 USD por millón de tókenes con vLLM.

Empezar