NVIDIA NVLink et commutateur NVLink

Scale-up networking fabric with high-bandwidth GPU-to-GPU communications for AI training, inference, and other demanding rack-scale GPU-accelerated workloads.

La nécessité d'une interconnexion évolutive plus rapide

Atteindre les performances les plus élevées des derniers modèles d'IA requiert des communications GPU à GPU fluides et haut débit sur l'ensemble du rack de serveur. Grâce à une faible latence, une bande passante de mise en réseau massive et une connectivité complète, la sixième génération de NVIDIA NVLink™ et du commutateur NVLink est conçue pour accélérer l'entraînement et l'inférence pour un raisonnement et des charges de travail d'IA agentique plus rapides.

Maximisez le rendement et la disponibilité de votre système avec NVIDIA NVLink

NVLink de 5ᵉ génération améliore considérablement l'évolutivité des systèmes multi-GPU de grande taille en permettant aux GPU de partager leur mémoire et les calculs pour les workflows d'entraînement, d'inférence et de raisonnement. Un unique GPU NVIDIA Blackwell prend en charge jusqu'à 18 connexions NVLink à 100 giga-octets par seconde (Go/s), soit une bande passante totale de 1,8 téraoctet par seconde (To/s), c'est-à-dire deux fois plus que la génération précédente et plus de 14 fois plus qu'avec PCIe de 5ᵉ génération. Les plateformes de serveur telles que NVIDIA GB300 NVL72 tirent parti de cette technologie pour offrir une plus grande évolutivité pour les grands modèles les plus complexes d'aujourd'hui.

Performances de NVLink à grande échelle

La sixième génération NVIDIA NVLink dans NVIDIA Rubin double la bande passante de communication GPU à GPU par rapport à la génération précédente pour un entraînement et une inférence plus rapides avec les dernières architectures de modèles d'IA.

Améliorez le débit de raisonnement avec les communications NVLink

Connectez intégralement vos GPU avec NVIDIA NVLink et le commutateur NVLink

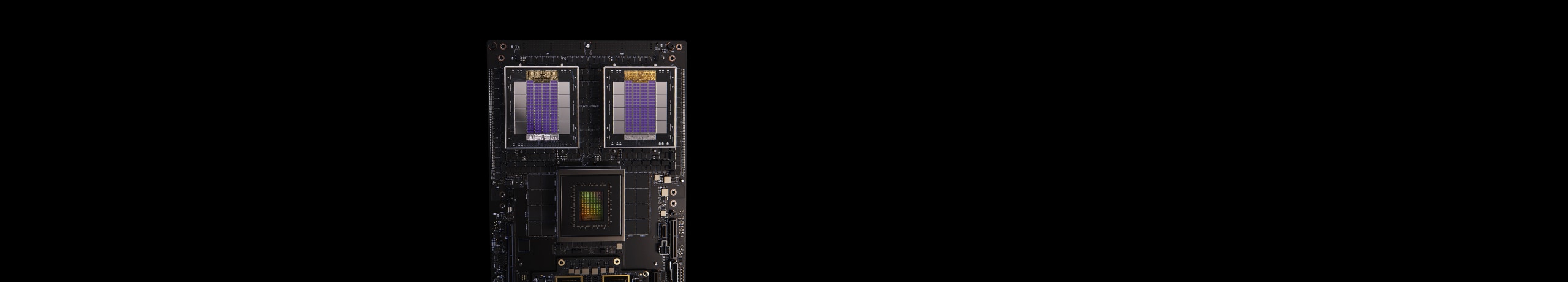

NVLink est une interconnexion bidirectionnelle directe GPU vers GPU de 3,6 To/s adaptant les entrées et sorties (IO) de plusieurs GPU au sein d'un serveur. Les puces de commutation NVIDIA NVLink connectent plusieurs NVLinks pour fournir une communication GPU complète à pleine vitesse NVLink sur l'ensemble de la baie.

Pour mettre en œuvre des opérations collectives à haute vitesse, chaque commutateur NVLink dispose de moteurs pour le protocole SHARP™ (Scalable Hierarchical Aggregation Reduction Protocol) de NVIDIA pour la réduction de la latence et l’accélération des multi-diffusions sur le réseau.

Accélérez les délais de raisonnement sur les modèles à plusieurs billions de paramètres grâce au système de commutation NVLink

Grâce aux commutateurs NVSwitch, les connexions NVLink peuvent être étendues sur plusieurs nœuds afin de créer un cluster de GPU multi-nœuds à haute bande passante à la fois fluide et efficace, ce qui permet de former un GPU de la taille d’un Data Center. Le commutateur NVIDIA NVLink permet une bande passante GPU de 260 To/s dans un NVIDIA Vera Rubin NVL72 pour le parallélisme des grands modèles. Les clusters multi-serveurs avec NVLink font évoluer les communications des GPU tout en équilibrant avec l'accroissement du calcul, de sorte que NVL72 peut prendre en charge jusqu'à neuf fois plus de GPU qu'un seul système à huit GPU.

NVIDIA NVLink Fusion

NVIDIA NVLink Fusion offre une mise à l'échelle des performances d'IA de pointe pour le calcul personnalisé, permettant ainsi aux fournisseurs de services Hyperscale de développer une infrastructure d'IA commune avec la technologie NVIDIA NVLink et l'architecture à l'échelle du rack.

Entrez dans l’ère du calcul exascale

Connexion intégrale pour des performances incomparables

La puce de commutation NVLink de Vera Rubin NVL72 permet d'interconnecter entièrement 72 GPU dans une structure de calcul sans blocage. Le commutateur NVLink interconnecte toutes les paires de GPU à une vitesse incroyable de 3,6 To/s. Il prend intégralement en charge les communications All-to-All. Les 72 GPU du domaine Vera Rubin NVL72 peuvent être utilisés en tant qu’accélérateurs uniques à hautes performances offrant une puissance de calcul IA pouvant atteindre 3,6 exaflop.

La plateforme d’IA et de HPC la plus puissante au monde

NVLink et le commutateur NVLink sont des composants clés de la solution de Data Center intégrale NVIDIA, qui comprend matériel, mise en réseau, logiciels, bibliothèques, ainsi que des modèles et des applications d'IA optimisés tirés de la suite logicielle NVIDIA AI Enterprise et du catalogue NVIDIA NGC™. Cette plateforme d'IA et de calcul intensif de bout en bout la plus puissante du marché permet aux chercheurs d'obtenir des résultats concrets et de déployer des solutions en production, pour une accélération sans précédent quelle que soit l'échelle.

Spécifications

-

NVLink

-

Commutateur NVLink

| Quatrième génération | Cinquième génération | Sixième génération | |

|---|---|---|---|

| Bande passante NVLink par GPU | 900 Go/s | 1800 Go/s | 3 600 Go/s |

| Architectures NVIDIA compatibles | 18 | 18 | 36 |

| Architectures NVIDIA compatibles | Architecture NVIDIA Hopper™ | Architecture NVIDIA Blackwell | NVIDIA Rubin Plateforme |

| Commutateur NVLink 4 | Commutateur NVLink 5 | Commutateur NVLink 6 | |

|---|---|---|---|

| Domaines GPU NVLink | 8 | 8 |72 | 8 |72 |

| Bande passante GPU vers GPU avec commutateur NVLink | 900 Go/s | 1 800 Go/s | 3 600 Go/s |

| Bande passante globale | 7,2 To/s | 130 To/s (NVL72) | 260 To/s (NVL72) |

| Architectures NVIDIA compatibles | Architecture NVIDIA Hopper™ | Architecture NVIDIA Blackwell | NVIDIA Rubin Plateforme |

Spécifications préliminaires susceptibles d’être modifiées.

NVIDIA Blackwell Ultra offre des performances jusqu'à 50 fois supérieures et des coûts 35 fois inférieurs pour l'IA agentique

Conçu pour accélérer la nouvelle génération d'IA agentique, NVIDIA Blackwell Ultra offre des performances d'inférence révolutionnaires à des coûts considérablement réduits. Les fournisseurs Cloud tels que Microsoft, CoreWeave et Oracle Cloud Infrastructure déploient des systèmes NVIDIA GB300 NVL72 à grande échelle pour des cas d'utilisation à faible latence et à long contexte, tels que le codage agentique et les assistants de codage.

Cette initiative de mise à niveau axée sur l'excellence permet la co-conception approfondie sur NVIDIA Blackwell, NVLink™ et NVLink Switch pour l’évolutivité, NVFP4 pour la précision, NVIDIA Dynamo et les LLM TensorRT™ pour la vitesse et la flexibilité, ainsi que le développement avec les frameworks communautaires SGLang, vLLM et bien plus encore.

Présentation de la plateforme NVIDIA Rubin.