Überblick

Was ist Gesprächs-KI?

Gesprächs-KI unterstützt virtuelle KI-Assistenten, digitale Menschen und Chatbots – die den Weg für personalisierte, natürliche Mensch-Maschine-Gespräche ebnen. Echtzeit-Interaktionen erfordern jedoch Geschwindigkeit und Genauigkeit. Mit offenen Nemotron-Speech-Modellen und der NVIDIA Riva-Bibliothek können Entwickler reaktionsschnelle Sprach- und Übersetzungsfunktionen erstellen und natürliche Sprachschnittstellen zu agentischen KI-Anwendungen hinzufügen.

Vorteile

Lernen Sie die Vorteile von Gesprächs-KI kennen

Effizienz von Agenten

Unterstützen Sie Kontaktcenter-Agenten durch die Transkription und Analyse von Kundengesprächen und Empfehlungen zur schnellen Lösung von Kundenfragen in Echtzeit.

Digitale und globale Zugänglichkeit

Ermöglichen Sie Menschen mit Hörbehinderungen den Konsum von Audioinhalten und Personen mit Sprachbeeinträchtigungen, sich in mehreren Sprachen auszudrücken.

Verfügbarkeit rund um die Uhr

Nutzen Sie Chatbots und virtuelle KI-Assistenten außerhalb der normalen Geschäftszeiten der menschlichen Mitarbeiter zur Beantwortung von Kundenanfragen und zur Bereitstellung nützlicher Informationen.

Ansprechende Erlebnisse

Bieten Sie ansprechende Erlebnisse mit Funktionen wie Live-Untertitelung, ausdrucksstarken synthetischen Stimmen und dem Verständnis der Kundenpräferenzen.

Software

Lernen Sie unsere Gesprächs-KI-Software kennen

Anwendungsbeispiele

Der Einsatz von Gesprächs-KI

Erfahren Sie, wie NVIDIA AI Anwendungsfälle in der Branche unterstützt, und starten Sie Ihre Entwicklung mit Gesprächs-KI mit kuratierten Beispielen.

-

Agenten im Gesundheitswesen

-

Virtueller KI-Assistent

-

Agenten-Assistenz

-

KI-Übersetzung

-

Physische KI

Agenten im Gesundheitswesen

Das Gesundheitswesen gestaltet die Interaktionen mit Patienten, die mit hochpräziser, kontextbezogener KI arbeiten, neu. Durch die Nutzung von Nemotron-Modellen können Unternehmen jetzt die Lücke zwischen klinischer Effizienz und dem Patientenerlebnis schließen. Sprachagenten von Ambient-Anbietern

generieren strukturierte klinische Dokumentation autonom und verstehen Kontext und Absicht. Sprachagenten bewältigen viele Patienten-Touchpoints wie Planung und Aufnahme mit dynamischem Reasoning für empathische, personalisierte Interaktionen.

Virtueller KI-Assistent

Viele Unternehmen setzen virtuelle KI-Assistenten ein, um Fragen von Millionen von Kunden und Mitarbeitenden rund um die Uhr effizient zu beantworten. Diese KI-Teamkollegen werden von angepassten NVIDIA Nemotron-Modellen wie LLMs, RAG und Sprach-KI unterstützt und liefern sofortige und natürlich klingende Antworten, selbst bei Hintergrundgeräuschen, schlechter Tonqualität sowie verschiedenen Dialekten und Akzenten.

Agenten-Assistenz

Verbraucher erwarten von Mitarbeitenden im Kontaktcenter, dass sie ihre Probleme schnell und effizient lösen. Damit menschliche Agenten die bestmöglichen Erlebnisse bereitstellen können, setzen Unternehmen in verschiedenen Branchen Agenten-Assistenz-Technologie auf der Grundlage von Nemotron-Modellen für RAG, LLMs und Sprach-KI ein. Diese Technologie liefert Fakten und Vorschläge in Echtzeit und hilft den Agenten, effektiver und effizienter zu reagieren. Der RAG Blueprint kann generative KI-Anwendungen durch schnellen Informationsabruf verbessern und KI-Agenten mit sofortigem Wissen aus riesigen Datenmengen versorgen.

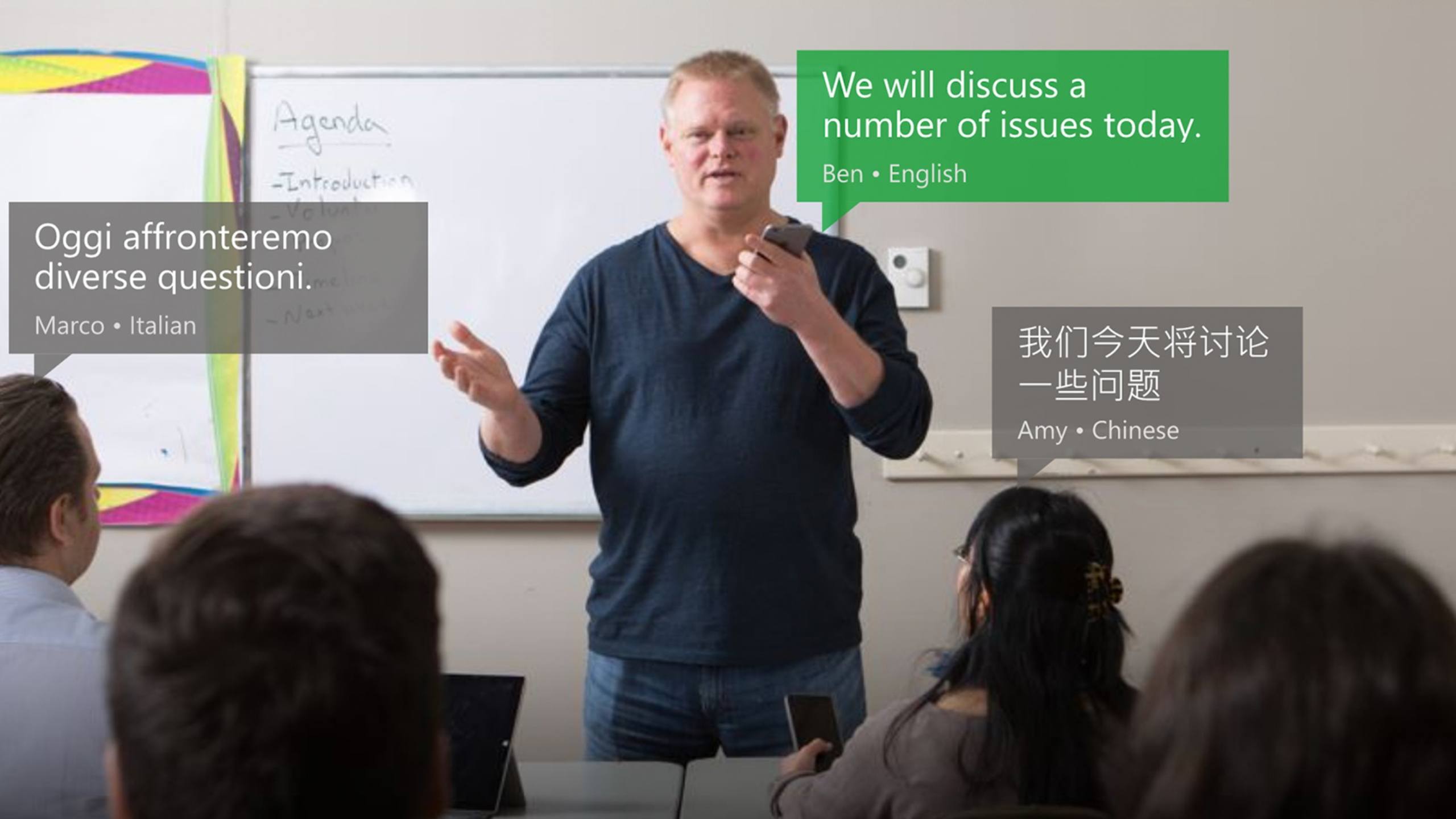

KI-Übersetzung

In der globalen Wirtschaft halten Unternehmen täglich Millionen von Online-Meetings ab und bedienen Kunden mit unterschiedlichem sprachlichem Hintergrund. Unternehmen erzielen genaue Live-Untertitelung mit Echtzeit-Transkription und -Übersetzung, die weltweite Akzente und fachspezifische Vokabulare berücksichtigt. Sie können Nemotron-Modelle für Zusammenfassungen und Erkenntnisse verwenden und so eine effektive Kommunikation und reibungslose globale Interaktionen gewährleisten.

Physische KI

Serviceroboter und sprachgesteuerte Maschinen werden zunehmend in Krankenhäusern, Fertigungsstätten, Flughäfen und Einzelhandelsgeschäften weltweit eingesetzt. Sie entlasten Mitarbeiter an vorderster Front, indem sie tägliche sich wiederholende Aufgaben in Restaurants und Fertigungsanlagen erledigen, Kunden beim Auffinden von Artikeln in Geschäften helfen und Ärzte sowie Pflegepersonal bei der Patientenversorgung unterstützen. Durch die Bereitstellung von Nemotron-Sprachmodellen direkt am Edge bieten diese Roboter nahezu sofortige verbale Interaktion und erhalten die Betriebszuverlässigkeit selbst in Umgebungen mit eingeschränkter Konnektivität aufrecht.