NVIDIA NVLink und NVLink Switch

Scale-up networking fabric with high-bandwidth GPU-to-GPU communications for AI training, inference, and other demanding rack-scale GPU-accelerated workloads.

Die Notwendigkeit einer schnelleren Skalierungsverbindung

Um die höchste Leistung für die neuesten KI-Modelle zu erzielen, ist eine nahtlose GPU-zu-GPU-Kommunikation mit hohem Durchsatz im gesamten Server-Rack erforderlich. Mit geringer Latenz, einer enormen Netzwerkbandbreite und einer All-to-All-Konnektivität wurden der NVIDIA NVLink™ und der NVLink-Switch der sechsten Generation entwickelt, um Training und Inferenz für schnelleres Schlussfolgern und agentische KI-Workloads zu beschleunigen.

Maximierung des Systemdurchsatzes und der Betriebszeit mit NVIDIA NVLink

Der NVLink der sechsten Generation ermöglicht eine Bandbreite von 3,6 TB/s pro GPU für die NVIDIA Rubin-Plattform – doppelt so viel Bandbreite wie die Vorgängergeneration und über die 14-fache Bandbreite von PCIe Gen6. Architekturen im Rack-Maßstab wie NVIDIA Vera Rubin NVL72 verbinden 72 GPUs in einer All-to-All-Topologie für insgesamt 260 TB/s und bieten eine enorme Bandbreite für die All-to-All-Kommunikation, die für das Training und die Inferenz führender Mixture-of-Experts-Modellarchitekturen erforderlich ist. NVLink 6 Switch bietet außerdem neue Verwaltungs- und Resilienzfunktionen, die zur Maximierung der Systemverfügbarkeit entwickelt wurden, einschließlich Resilienz auf der Kontrollebene, der Möglichkeit, ein teilbestücktes Rack zu betreiben, und Hot-Swapping (Austausch im laufenden Betrieb) von Switch-Trays.

NVLink At-Scale-Leistung

NVIDIA NVLink der sechsten Generation in NVIDIA Rubin erhöht die Bandbreite der GPU-zu-GPU-Kommunikation um das Doppelte im Vergleich zur Vorgängergeneration für schnelleres Training und Inferenz mit den neuesten KI-Modellarchitekturen.

Höherer Reasoning-Durchsatz mit NVLink-Kommunikation

Vollständig verbundene Grafikkarten mit NVIDIA NVLink und NVLink-Switch

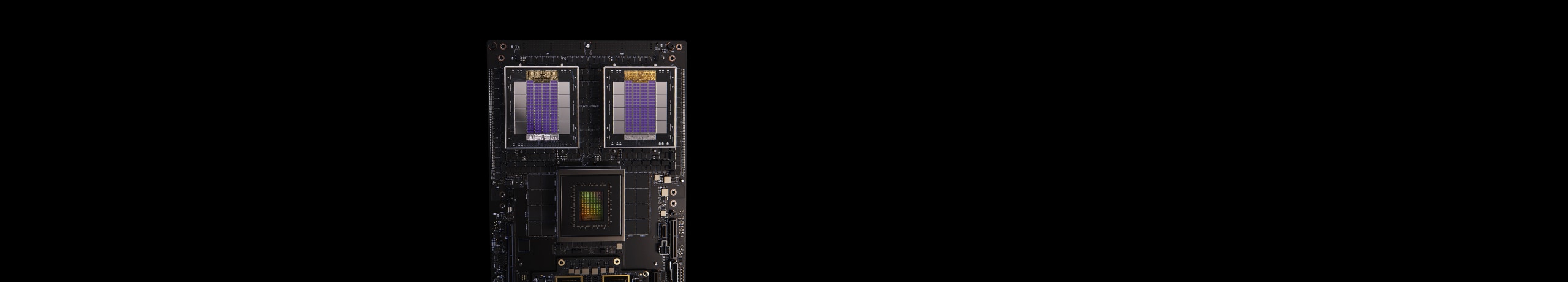

NVLink ist eine bidirektionale, direkte GPU-zu-GPU-Verbindung mit 3,6 TB/s, die Multi-GPU-In- und Output (IO) innerhalb eines Servers skaliert. Die NVIDIA NVLink-Switch-Chips verbinden mehrere NVLinks, um eine All-to-All-GPU-Kommunikation mit voller NVLink-Geschwindigkeit im gesamten Rack zu ermöglichen.

Um einen kollektiven Hochgeschwindigkeitsbetrieb zu ermöglichen, verfügt jeder NVLink-Switch über Engines für das NVIDIA Scalable Hierarchical Aggregation and Reduction Protocol (SHARP)™ für In-Network-Reduktionen und Multicast-Beschleunigung.

Beschleunigen Sie das Testzeit-Reasoning für Billionen von Parametermodellen mit dem NVLink-Switch-System

Mit NVLink Switch können NVLink-Verbindungen über Knoten hinweg ausgedehnt werden, um einen nahtlosen GPU-Cluster mit hoher Bandbreite zu bilden, der mehrere Knoten umfasst und eine effektive GPU für Rechenzentren bildet. Der NVIDIA NVLink Switch ermöglicht eine GPU-Bandbreite von 260 TB/s in einem NVIDIA Vera Rubin NVL72 für die Parallelität großer Modelle. Multi-Server-Cluster mit NVLink skalieren die GPU-Kommunikation im Gleichgewicht mit der erhöhten Rechenleistung, sodass NVIDIA Vera Rubin NVL72 die neunfache GPU-Anzahl im Vergleich zu einem einzigen System mit acht GPUs unterstützen kann.

NVIDIA NVLink Fusion

NVIDIA NVLink Fusion bietet branchenführende Skalierung der KI-Leistung für maßgeschneidertes Computing, sodass Hyperscaler eine gemeinsame KI-Infrastruktur mit NVIDIA NVLink Fusion und Architektur im Rack-Maßstab entwickeln können.

Skalierung von Enterprise auf Exascale

Vollständige Verbindung für unübertroffene Leistung

Der NVLink-Switch-Chip in Vera Rubin NVL72 ermöglicht 72 vollständig verbundene GPUs in einer nicht blockierenden Rechenstruktur. Der NVLink-Switch verbindet jedes GPU-Paar mit unglaublichen 3,6 TB/s. Er unterstützt eine vollständig allseitige Kommunikation. Die 72 Grafikkarten in Vera Rubin NVL72 können als ein einzelner Hochleistungsbeschleuniger mit bis zu 3,6 exaFLOPS KI-Rechenleistung verwendet werden.

Die leistungsstärkste AI- und HPC-Plattform

NVLink und NVLink Switch sind wichtige Bausteine der kompletten NVIDIA-Lösung für Rechenzentren, die Hardware, Netzwerke, Software, Bibliotheken und optimierte KI-Modelle und -Anwendungen aus der NVIDIA AI Enterprise-Softwaresuite und dem NVIDIA NGC™-Katalog umfasst. Die extrem leistungsstarke End-to-End-Plattform für KI und HPC ermöglicht es Forschern, konkrete Ergebnisse zu liefern sowie Lösungen für die Produktion bereitzustellen und bietet bei jeder Größenordnung eine beispiellose Beschleunigung.

Technische Daten

-

NVLink

-

NVLink-Switch

| Vierte Generation | Fünfte Generation | Sechste Generation | |

|---|---|---|---|

| NVLink-Bandbreite pro GPU | 900 GB/s | 1,800 GB/s | 3,600 GB/s |

| Maximale Anzahl an Links pro Grafikkarte | 18 | 18 | 36 |

| Unterstützte NVIDIA-Architekturen | NVIDIA™ Hopper-Architektur | NVIDIA Blackwell-Architektur | NVIDIA Rubin Platform |

| NVLink 4 Switch | NVLink 5 Switch | NVLink 6 Switch | |

|---|---|---|---|

| NVLink GPU-Domänen | 8 | 8 |72 | 8 |72 |

| NVLink Switch GPU-zu-GPU Bandbreite | 900 GB/s | 1.800 GB/s | 3.600 GB/s |

| Gesamte aggregierte Bandbreite | 7.2 TB/s | 130 TB/s (NVL72) | 260 TB/s (NVL72) |

| Unterstützte NVIDIA-Architekturen | NVIDIA™ Hopper-Architektur | NVIDIA Blackwell-Architektur | NVIDIA Rubin Platform |

Vorläufige Spezifikationen, Änderungen möglich

NVIDIA Blackwell Ultra liefert bis zu 50-mal bessere Leistung und 35-mal geringere Kosten für agentische KI

NVIDIA Blackwell Ultra wurde entwickelt, um die nächste Generation der agentischen KI zu beschleunigen und bietet bahnbrechende Inferenzleistung bei deutlich geringeren Kosten. Cloud-Anbieter wie Microsoft, CoreWeave und Oracle Cloud Infrastructure setzen NVIDIA GB300 NVL72-Systeme in großem Maßstab für Anwendungsfälle mit geringer Latenz und langer Kontextdauer ein, wie zum Beispiel agentische Programmierung und Programmierassistenten.

Dies wird durch ein eng abgestimmtes Co-Design zwischen NVIDIA Blackwell, NVLink™ und NVLink Switch für Scale-out, NVFP4 für Genauigkeit bei Berechnungen mit niedriger Präzision und NVIDIA Dynamo sowie TensorRT™ LLM für Geschwindigkeit und Flexibilität ermöglicht – sowie durch die Entwicklung mit Community-Frameworks wie SGLang, vLLM und mehr.

Tiefer Einblick in die NVIDIA Blackwell-Architektur