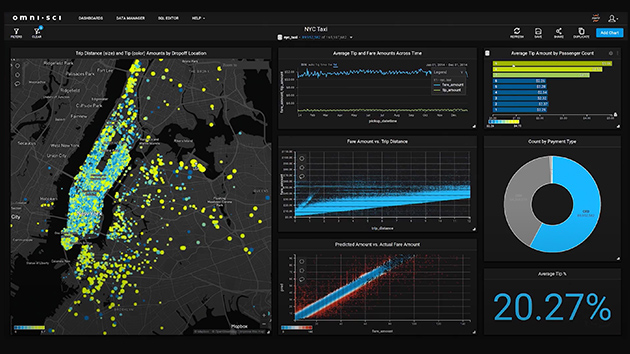

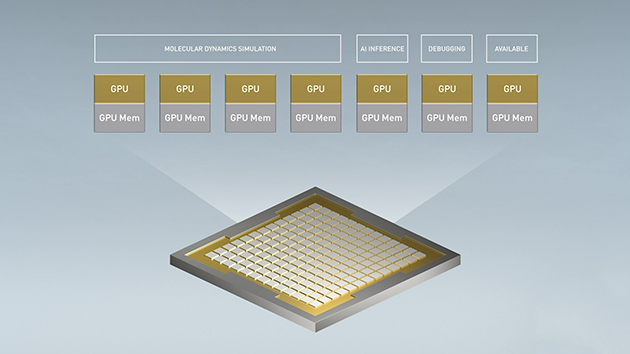

Steigern Sie die Leistung für jeden Enterprise-Workload mit der NVIDIA A30 Tensor-Core-GPU. Mit der NVIDIA Ampere-Architektur-Tensor-Cores und Multi-Instanz-GPU (MIG) sind hohe Geschwindigkeiten sicher über verschiedene Workloads hinweg möglich, einschließlich KI-Inferenz im großen Maßstab und Hochleistungs-Computing(HPC)-Anwendungen. Durch die Kombination schneller Speicherbandbreite und geringen Stromverbrauchs im PCIe-Formfaktor – optimal für Mainstream-Server – ermöglicht die A30 ein flexibles Rechenzentrum und bietet maximalen Nutzen für Unternehmen.

NVIDIA A30 Tensor-Core-GPU

Vielseitige Rechenbeschleunigung für Mainstream-Enterprise-Server.